はじめに

近年、大規模言語モデル(LLM)の進化により、AIが科学研究や新薬開発といった複雑な分野で活躍することへの期待が高まっています。しかし、現在のAIには「なぜその結論に至ったのか」という思考のプロセスが不透明であったり、専門家がそのプロセスに介入して修正したりすることが難しいという課題がありました。

本稿では、こうした課題の解決を目指す新しいアプローチとして、Microsoft Researchが発表した「CLIO」という技術について、解説します。この技術は、AIがまるで人間のように自問自答を繰り返しながら、問題解決能力をその場で高めていく仕組みです。

参考記事

- タイトル: Self-adaptive reasoning for science

- 発行元: Microsoft Research

- 発行日: 2025年8月6日

- URL: https://www.microsoft.com/en-us/research/blog/self-adaptive-reasoning-for-science/

・本稿中の画像に関しては特に明示がない場合、引用元記事より引用しております。

・記載されている情報は、投稿日までに確認された内容となります。正確な情報に関しては、各種公式HPを参照するようお願い致します。

・内容に関してはあくまで執筆者の認識であり、誤っている場合があります。引用元記事を確認するようお願い致します。

要点

- Microsoftは、AIが科学のような複雑な問題に取り組むための新アプローチ「CLIO」を開発した。

- CLIOは、特別な推論訓練を受けていない汎用言語モデルに、実行時に自ら思考プロセスを構築・適応させる「自己適応型推論」を可能にするものである。

- このアプローチは、追加の学習データや強化学習に依存せず、代わりに「自己反映ループ」を用いて問題を多角的に検討し、思考を深める。

- 結果として、AIの思考プロセスが透明化され、研究者はその推論過程を制御・修正できるようになり、AIの信頼性が向上する。

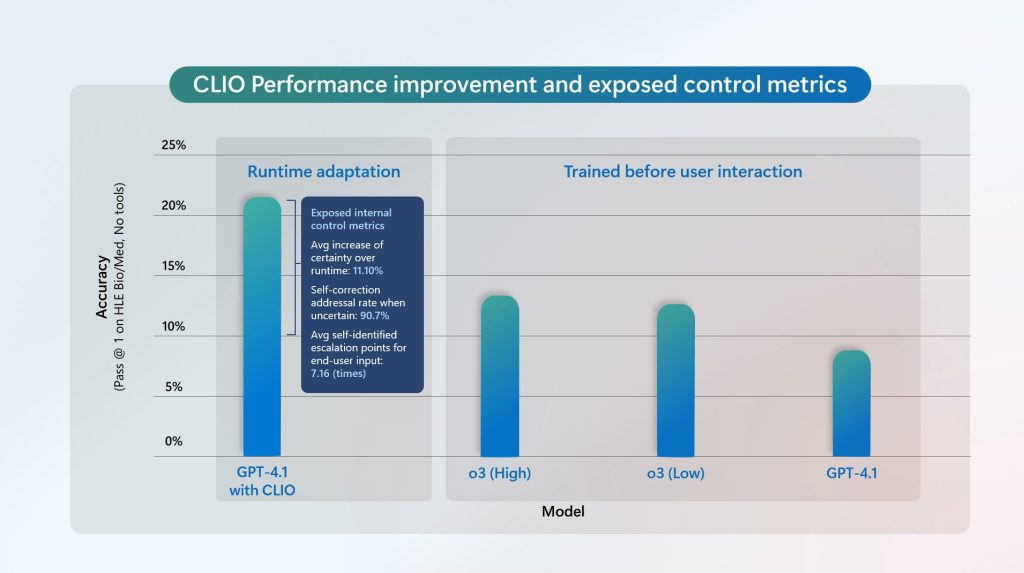

- 性能評価では、GPT-4.1の正解率を8.55%から22.37%へと大幅に向上させ、専門的な訓練を受けた推論モデルを上回る成果を示した。

- CLIOは、AIの「ブラックボックス問題」を緩和し、科学における信頼性の高いAI活用への道を開く重要な技術である。

詳細解説

現代のAIエージェントが抱える「制御」と「信頼性」の課題

新素材の開発や創薬など、大きなインパクトをもたらす可能性を秘めた科学的発見の領域では、高度な推論能力を持つAIエージェントの活用が期待されています。しかし、AIが自律的にタスクを進めるようになると、その行動を人間が適切に監督し、結果に対する説明責任をどう確保するかが大きな課題となります。

従来の多くの推論モデルでは、その思考パターンはモデル開発者によって、ユーザーに提供される前の「ポストトレーニング」という段階で組み込まれてしまいます。これは、AIの振る舞いが事前に「焼き付けられている」ようなもので、利用する科学者や研究者がその場でAIの思考プロセスを細かく制御したり、修正したりする余地はほとんどありませんでした。この「ブラックボックス」状態は、特に厳密さや再現性が求められる科学の分野では、AIを信頼して活用する上での大きな障壁となっていました。

新アプローチ「CLIO」とは?

この課題に対し、Microsoftは「継続的に操縦可能な仮想科学者」というビジョンを掲げ、CLIO (Cognitive Loop via In-situ Optimization) という新しいアプローチを開発しました。日本語では「その場での最適化による認知ループ」と訳せます。

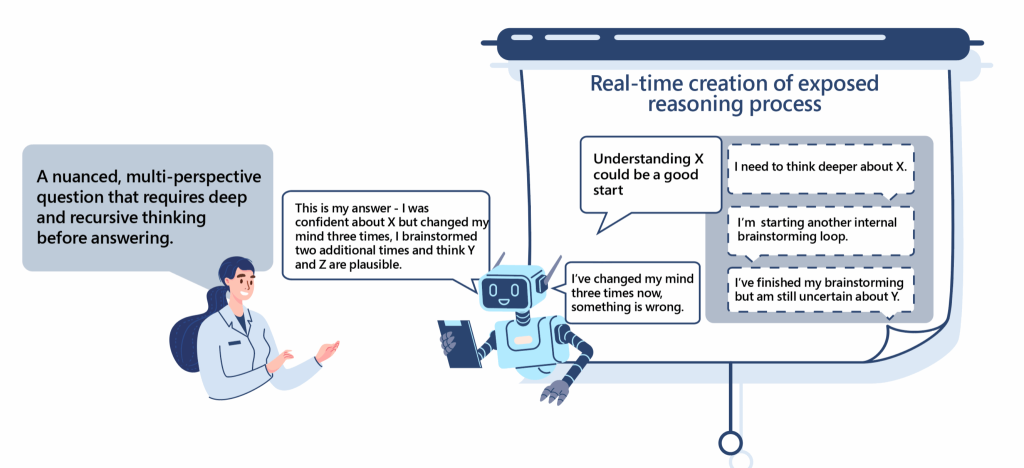

CLIOの最も重要な特徴は、推論能力を持つように特別に訓練されていない、ごく一般的な言語モデル(ベースモデル)を使い、問題解決の実行中に自ら思考パターンを発展させていく点にあります。事前に大量の正解データを読み込ませて訓練するのではなく、問題に直面したその場で、AI自身が「自己反映ループ(reflection loops)」と呼ばれるプロセスを通じて、思考を深めていくのです。

この「自己反映ループ」とは、人間が難しい問題に取り組む際に「この方針で良いだろうか?」「もっと深く考える必要がありそうだ」「別の角度から試してみよう」と自問自答するプロセスに似ています。CLIOは、この内省的なプロセスをAIで実現し、アイデアを探求したり、過去の推論を記憶から呼び出して参照したり、自身の行動を制御したりといった活動を自律的に行います。

CLIOはどのように機能するのか?(技術的ポイント)

CLIOは、主に3つの重要な機能によって、自己適応的な推論を実現しています。

思考の深化(再帰的なループ)

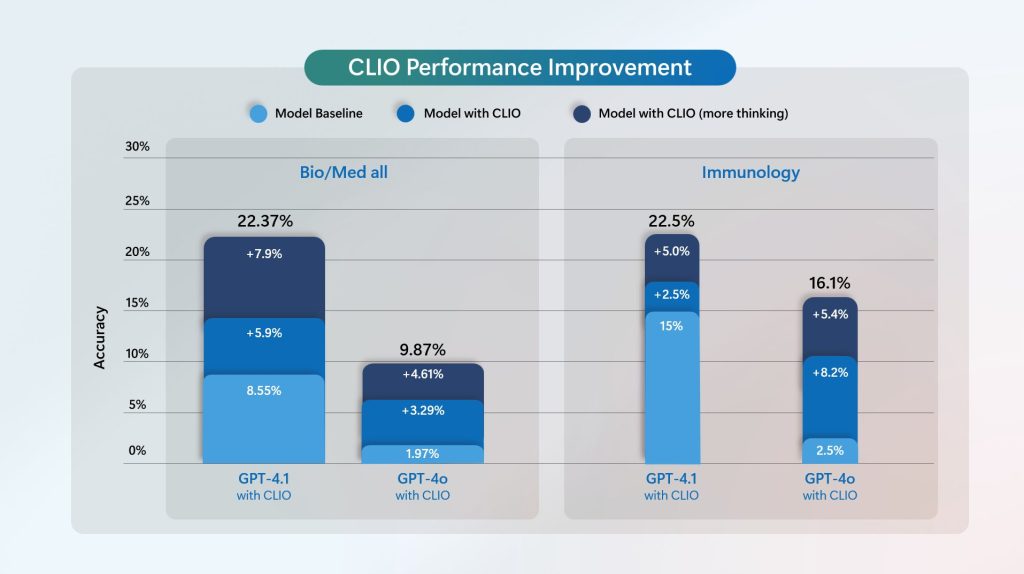

CLIOは、認知ループを再帰的に(繰り返し)実行することで、問題の表面的な理解にとどまらず、より深く掘り下げて考えることができます。元記事の実験では、この再帰的な思考ループを導入するだけで、GPT-4.1の正解率が5.92%向上したことが示されています。

思考の拡張(アンサンブルによる最適なアプローチ選択)

さらに、CLIOは複数の異なる思考経路(記事中では”evolutions”と表現)を同時に試すことができます。そして、それらの思考経路の結果を統合し、どの戦略が最も優れているかをインテリジェントに選択します。このアプローチは「アンサンブル」と呼ばれ、単一の思考経路に頼るよりも、より頑健で質の高い結論を導き出すことができます。この拡張機能により、正解率はさらに7.90%向上しました。

不確実性の管理とユーザーによる制御

CLIOの優れた点は、性能向上だけではありません。AI自身が自分の推論における不確実性を認識できることです。推論の途中で自信が持てない箇所や、矛盾が生じた箇所を特定すると、CLIOはそこに「フラグ」を立ててユーザーに知らせます。

これにより、科学者はAIの思考プロセスをただ眺めるだけでなく、「なぜここで迷っているのか」を理解し、その部分を修正したり、別の情報を提供したりして、AIの推論を正しい方向へ導くことができます。AIが闇雲に間違った答えを自信満々に提示する危険性を減らし、人間とAIが協力して問題解決にあたるための、信頼性の高い基盤を築くことができます。

性能向上

CLIOの有効性を示すために、Microsoftは「Humanity’s Last Exam (HLE)」という、大学院レベルの非常に難易度の高い科学問題を含むベンチマークを使用しました。

結果は非常に印象的でした。グラフが示すように、生物学・医学分野のテキスト問題において、CLIOを適用したGPT-4.1は、正解率が8.55%から22.37%へと飛躍的に向上しました。これは、正解率を161%以上改善したことに相当し、高度な推論能力を持つように事前に訓練されたモデル(o3 (High))の性能をも上回りました。

さらに注目すべきは、この技術が特定のモデルに依存しない「モデル非依存」である点です。例えば、元々はHLEのような高難易度の問題を得意としていなかったGPT-4oでさえ、CLIOを適用することで、免疫学の分野では最先端の推論モデルに匹敵するレベルまで性能が向上しました。これは、CLIOが特定のAIモデルを強化するだけでなく、AIシステム全体の推論能力を底上げする汎用的なフレームワークであることを示しています。

まとめ

本稿では、Microsoft Researchが開発した新しいAIアプローチ「CLIO」について解説しました。

CLIOは、AIが実行時に自ら思考プロセスを構築・適応させる「自己適応型推論」を実現する技術です。追加の学習データや強化学習に頼ることなく、AI自身が「自己反映ループ」を通じて思考を深め、拡張していきます。

この技術の真価は、単にAIの性能を向上させるだけではありません。AIの思考プロセスを透明化し、人間がその過程を制御できるようにすることで、AIに対する信頼性を根本的に高める点にあります。AIが自信のない部分を自ら示し、人間に助けを求めることができるため、人間とAIが真の意味で協力し、科学のような複雑で未知の領域に挑むための道筋を示しています。

このアプローチは、科学研究にとどまらず、金融分析、工学、法務サービスなど、高い説明責任と信頼性が求められるあらゆる専門分野に応用できる可能性を秘めています。CLIOは、AIと人間が共存し、共に発展していく未来に向けた、重要な一歩と言えるでしょう。