はじめに

Google DeepMindが2025年12月19日、言語モデルの内部動作を理解するための解釈可能性ツール「Gemma Scope 2」を公開しました。本稿では、この発表内容をもとに、Gemma Scope 2の技術的特徴と、AI安全性研究における意義について解説します。

参考記事

- タイトル: Gemma Scope 2: helping the AI safety community deepen understanding of complex language model behavior

- 著者: Language Model Interpretability Team

- 発行元: Google DeepMind

- 発行日: 2025年12月19日

- URL: https://deepmind.google/blog/gemma-scope-2-helping-the-ai-safety-community-deepen-understanding-of-complex-language-model-behavior/

要点

- Gemma Scope 2は、Gemma 3モデルファミリー(270Mから27Bパラメータ)すべてに対応する包括的な解釈可能性ツールスイートである

- 約110ペタバイトのデータ保存と1兆パラメータ以上の学習を要し、AIラボによるオープンソース解釈可能性ツールとしては過去最大規模のリリースとなる

- Sparse Autoencoders(SAE)とTranscodersを組み合わせることで、モデルの内部処理を可視化し、ジェイルブレイクや幻覚などの安全性問題の研究を可能にする

- 初代Gemma Scopeから、全レイヤーカバレッジ、Skip-transcodersやCross-layer transcodersなどの高度なツール、Matryoshka学習技術の採用により大幅に強化されている

- チャットボット向けGemma 3のチューニング版に対応した解釈可能性ツールも提供され、複雑な振る舞いの分析が可能となった

詳細解説

Gemma Scope 2の概要と目的

大規模言語モデル(LLM)は高度な推論能力を持つ一方で、その内部の意思決定プロセスは不透明です。Google DeepMindによれば、システムが予期しない振る舞いをした際、内部動作が見えないことで原因特定が困難になると説明されています。

Gemma Scope 2は、Gemma 3モデルファミリー全体に対応する解釈可能性ツールキットです。解釈可能性研究とは、AIモデルの内部動作と学習されたアルゴリズムを理解することを目指す分野であり、AI能力と複雑性が増すにつれて、安全で信頼性の高いAI構築に不可欠な要素と考えられています。

Google DeepMindの発表では、約110ペタバイトのデータ保存と、合計1兆パラメータ以上の学習を必要としたと報告されています。これは、AIラボによるオープンソース解釈可能性ツールのリリースとしては、これまでで最大規模とのことです。

技術的アプローチ:SAEとTranscoders

Gemma Scope 2は、前身と同様に、Gemmaモデルファミリーの「顕微鏡」として機能します。Sparse Autoencoders(SAE)とTranscodersを組み合わせることで、研究者はモデル内部を観察し、モデルが何を「考えて」いるか、その思考がどのように形成され、振る舞いにつながるかを理解できます。

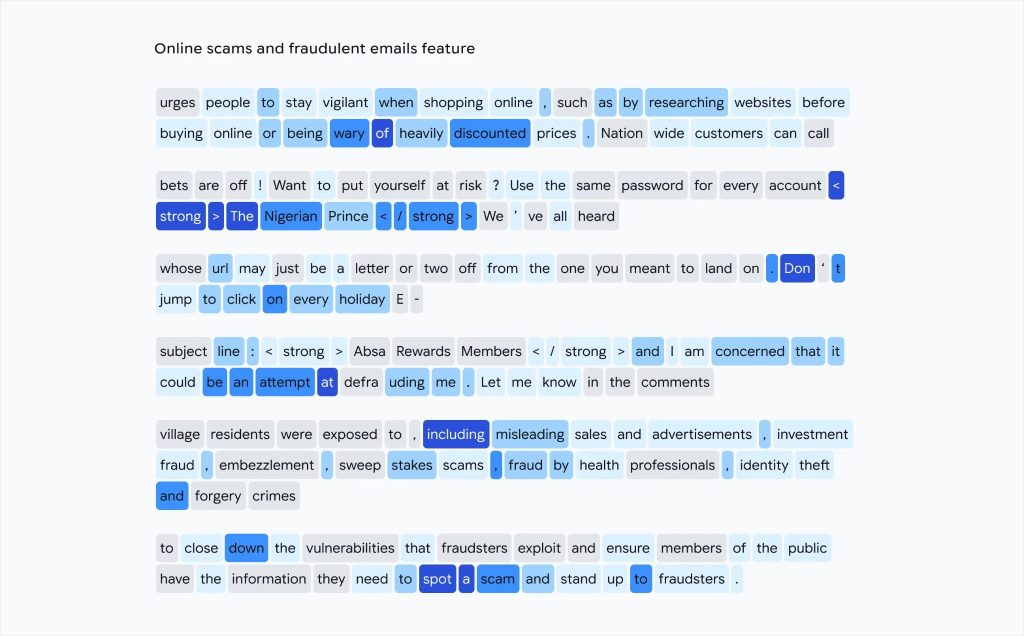

Sparse Autoencodersは、モデルの内部活性化を基礎的な概念に分解するツールで、生物学者が顕微鏡を使って植物や動物の個々の細胞を研究するのと同様の役割を果たします。この技術により、ジェイルブレイクやその他の安全性に関連するAIの振る舞い、例えばモデルが伝達する推論と内部状態の間の不一致などを、より詳細に研究することが可能になります。

初代Gemma Scopeからの主要な強化点

Google DeepMindによれば、初代Gemma Scopeは、モデルの幻覚、モデルが知っている秘密の特定、より安全なモデルの訓練など、重要な安全性分野の研究を可能にしましたが、Gemma Scope 2では以下の大幅な改良が加えられています。

規模での完全カバレッジ:

Gemma 3ファミリー全体(最大27Bパラメータ)に対応する完全なツールスイートを提供します。これは、規模でのみ現れる創発的な振る舞いの研究に不可欠です。Google DeepMindは、27Bサイズのモデルが新しいがん治療経路を発見した例を挙げていますが、Gemma Scope 2自体はこのモデルで訓練されていないものの、このような創発的振る舞いを理解できる可能性があると説明されています。

複雑な内部動作を解読するためのより洗練されたツール:

Gemma Scope 2には、Gemma 3ファミリーのすべてのレイヤーで訓練されたSAEとTranscodersが含まれています。Skip-transcodersとCross-layer transcodersにより、モデル全体に分散した多段階の計算とアルゴリズムの解読が容易になります。これらのツールは、モデルが情報をどのように層間で処理し、最終的な出力に至るかを追跡するのに役立つと考えられます。

高度な訓練技術:

最先端の技術、特にMatryoshka訓練技術を使用しています。この技術は、SAEがより有用な概念を検出するのを助け、初代Gemma Scopeで発見された特定の欠陥を解決するとのことです。Matryoshka訓練は、モデルの解釈可能性を向上させる技術として注目されており、より正確な概念の抽出を可能にすると思われます。

チャットボット動作分析ツール:

チャットユースケース向けにチューニングされたGemma 3バージョンを対象とした解釈可能性ツールも提供されます。これらのツールは、ジェイルブレイク、拒否メカニズム、思考連鎖の忠実性など、複雑な多段階の振る舞いの分析を可能にします。実際のチャットボットアプリケーションでは、これらの要素がユーザー体験と安全性に直接影響するため、重要な改善点と言えます。

AI安全性研究への貢献

Google DeepMindは、Gemma Scope 2のリリースにより、AI安全性研究コミュニティが最先端の解釈可能性ツールスイートを使用して分野を前進させることを目指していると述べています。このレベルのアクセスは、より大規模で現代的なLLMにおいてのみ発生する現実世界の安全性問題に取り組むために重要とのことです。

具体的には、研究コミュニティは以下のような活用が期待されます:

- モデルの創発的振る舞いのデバッグ

- AIエージェントのより良い監査とデバッグ

- ジェイルブレイク、幻覚、媚びへつらい(sycophancy)などの問題に対する実用的で堅牢な安全介入の開発加速

これらのツールがオープンソースとして提供されることで、世界中の研究者が共通のプラットフォームで安全性研究を進められる環境が整うと考えられます。透明性の高い研究基盤は、AI安全性分野の発展において重要な役割を果たす可能性があります。

利用可能なリソース

Gemma Scope 2は、複数の形式で利用可能です:

- Hugging Faceでのモデルウェイトダウンロード(270M、1B、4B、12B、27Bの各サイズ、事前訓練版とチャット版の両方):https://huggingface.co/google/gemma-scope-2

- Neuronpediaによるインタラクティブデモ:https://www.neuronpedia.org/gemma-3-4b

- Google Colabチュートリアル: Tutorial: Gemma Scope 2

- 技術サイト:https://deepmind.google/models/gemma/gemma-scope/

また、Google DeepMindは、このプロジェクトでGemma 3モデルの内部活性化を公開するために使用した社内ツール「Mishax」もGitHubで公開しています。これにより、研究者は同様のツール開発の参考にできると思われます。

まとめ

Gemma Scope 2は、AI解釈可能性研究において重要な一歩となる大規模なオープンソースリリースです。Gemma 3ファミリー全体をカバーする包括的なツールスイート、高度な訓練技術の採用、そしてチャットボット向けの専用ツールの提供により、AI安全性研究の新たな可能性が開かれたと言えます。今後、このツールを活用した研究成果が、より安全で信頼性の高いAIシステムの実現につながることが期待されます。