はじめに

近年、AI技術は目覚ましい発展を遂げていますが、特にビジネスの世界では、顧客情報、商品情報、購買履歴といった、複数のテーブル(表)にまたがる関係性のあるデータ(リレーショナルデータ)から価値ある洞察を引き出すことが重要になっています。しかし、従来のAI技術では、これらの複雑に絡み合ったデータの関係性を十分に捉えきれないという課題がありました。

本稿では、この課題を解決する画期的なAIアーキテクチャとして注目されている「Relational Graph Transformers(リレーショナル・グラフ・トランスフォーマー)」について解説します。

引用元記事

- タイトル: Relational Graph Transformers: A New Frontier in AI for Relational Data

- 発行元: Kumo.ai

- 発行日: 2025年4月28日

- URL: https://kumo.ai/research/relational-graph-transformers/

・本稿中の画像に関しては特に明示がない場合、引用元記事より引用しております。

・記載されている情報は、投稿日までに確認された内容となります。正確な情報に関しては、各種公式HPを参照するようお願い致します。

・内容に関してはあくまで執筆者の認識であり、誤っている場合があります。引用元記事を確認するようお願い致します。

要点

Relational Graph Transformersは、企業などが持つ複数のテーブルにまたがるリレーショナルデータベースの情報を、AIが効率的に学習するための新しい技術です。

- 課題: 従来のAIモデルは、複数のテーブル間の複雑な関係性を捉えるのが苦手でした。

- 解決策: データベース全体を「グラフ」という、点(ノード)とそれらを繋ぐ線(エッジ)で表現されるデータの繋がりとして捉え直します。これにより、テーブル間の関係性をAIが直接学習できるようになります。

- 技術: AI分野で大きな成功を収めている「Transformer(トランスフォーマー)」という技術を、このグラフ構造のデータに応用します。特に、「アテンションメカニズム」により、データ全体のどこに注目すべきかをAIが自ら学習し、重要な関係性を見つけ出します。

- 効果: 従来のAIアプローチと比較して、価値ある洞察を得るまでの時間を20倍高速化、予測精度を30-50%向上、データ準備の手間を95%削減といった目覚ましい成果が報告されています。

- 応用: 顧客分析、推薦システム、不正検知、需要予測など、幅広いビジネス分野での活用が期待されています。

詳細解説

1. 前提知識:リレーショナルデータベースとグラフ

Relational Graph Transformersを理解するために、まずいくつかの基本的な概念を押さえておきましょう。

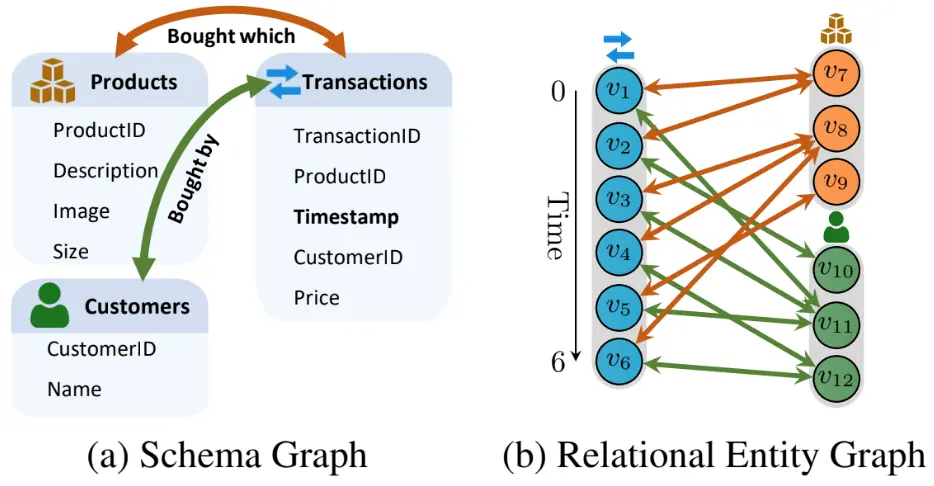

- リレーショナルデータベース: 多くの企業で使われている、情報を複数の「テーブル(表)」に整理して格納するデータベース形式です。例えば、「顧客テーブル」「商品テーブル」「購買履歴テーブル」のように分かれています。これらのテーブルは、「顧客ID」や「商品ID」といった共通のキー(外部キー)によって互いに関連付けられています。Excelのシートが複数あり、それらが特定の列でリンクしているイメージです。

- グラフ: データ構造の一種で、物事(ノードまたはエンティティ)とそれらの間の関係(エッジまたはリンク)で構成されます。SNSの友人関係図(人がノード、友達関係がエッジ)などが身近な例です。リレーショナルデータベースも、各テーブルの各行(顧客、商品、購買記録など)をノードとし、テーブル間の関連(例:「顧客Aが商品Bを購入した」)をエッジと見なすことで、グラフ構造として捉えることができます。

- Graph Neural Networks (GNNs): グラフ構造のデータを直接学習できるAIモデルの一種です。隣接するノード間で情報を交換(メッセージパッシング)することで、関係性を学習します。

- Transformers: もともと自然言語処理(翻訳や文章生成など)のために開発されたAIモデルです。「アテンションメカニズム」という仕組みを持ち、入力データの中でどの部分が特に関連性が高いかを動的に判断して学習します。

2. なぜRelational Graph Transformersが必要なのか?

従来の機械学習やAIモデルでは、リレーショナルデータベースのデータを扱う際に、複数のテーブルを無理やり一つの大きなテーブルに結合(フラット化)したり、手作業で特徴量(AIが学習しやすいデータの形式)を作成したりする必要がありました。これには多くの手間と時間がかかり、また、結合の過程で本来データが持っていた豊かな関係性の情報が失われてしまうという問題がありました。

Relational Graph Transformersは、この問題を根本的に解決します。データベースをグラフとして捉え、Transformer技術を応用することで、データ準備の手間を大幅に削減し、データ間の複雑な関係性を直接的かつ効果的に学習することを可能にします。

3. Relational Graph Transformersの仕組み

Relational Graph Transformersは、大きく以下のステップで動作します。

1.データベースからグラフへの変換:

- まず、データベースの構造(どのテーブルがあり、どう関連しているか)を示す「スキーマグラフ」を作成します。これはデータベース全体の設計図のようなものです。

- 次に、スキーマグラフに基づき、データベース内の各行(顧客、商品、取引など)をノード、行間の関連(外部キーによるリンク)をエッジとする巨大な「リレーショナルエンティティグラフ」を構築します。この際、ノードやエッジの種類(顧客ノード、商品ノード、「購入した」エッジなど)も区別されます(異種グラフ)。タイムスタンプ情報があれば、それもグラフに組み込みます。

2.Transformerによる学習:

- 構築されたリレーショナルエンティティグラフに対して、Transformerモデルを適用します。

- アテンションメカニズムにより、グラフ内の全てのノードが、他のどのノードと関連性が深いかを直接計算します。従来のGNNでは情報が伝わるのに数ステップ(ホップ)かかっていた遠いノード間の関係性も、Transformerなら直接捉えることができます。例えば、ある商品を購入した顧客と、別の商品を購入した顧客との間の(直接的ではない)関連性なども効率的に学習できます。

4. 従来のGraph Transformerとの違いと工夫

Relational Graph Transformersは、汎用的なGraph Transformerをリレーショナルデータに特化させるために、いくつかの重要な工夫が施されています。

- グラフ接続性の考慮: 標準的なTransformerは全ての要素が互いに接続されている(完全グラフ)と仮定しますが、これは大規模グラフでは計算コストが高すぎます。Relational Graph Transformersは、データベース本来の接続構造(スキーマ)を考慮し、主に近傍のノードとの関係に注目しつつ、アテンションによって遠くの重要なノードも見つけられるようにバランスを取っています。

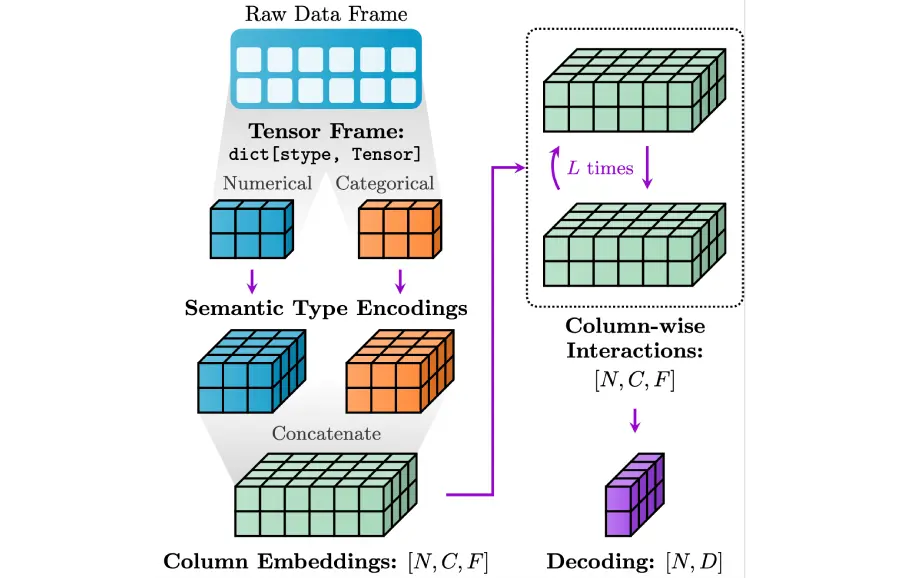

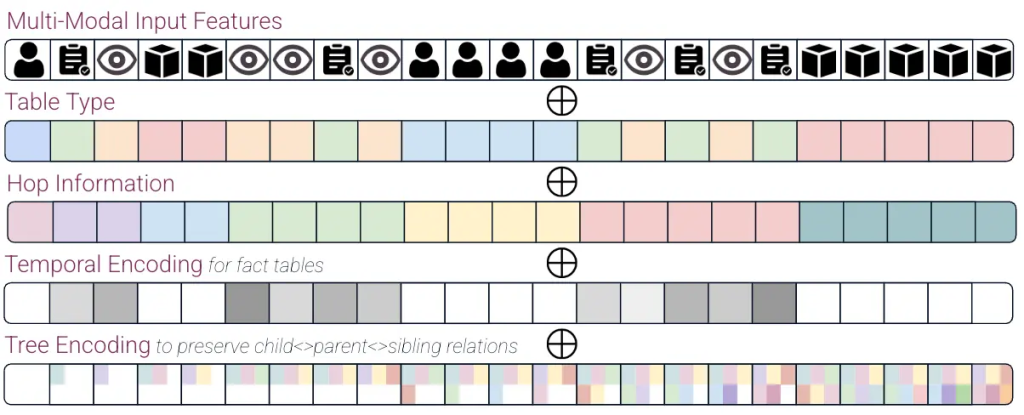

- 多様なデータ型(マルチモーダル)への対応: データベースのテーブルには、数値、カテゴリ(性別、商品カテゴリなど)、テキスト(商品説明)、画像、タイムスタンプなど、様々な種類のデータが含まれます。Relational Graph Transformersは、これらの多様なデータ型(マルチモーダルデータ)をそれぞれ適切に処理し、最終的に一つのベクトル表現(ノード埋め込み)に統合する仕組みを持っています。例えば、テキストは言語モデルで、画像は画像認識モデルで処理し、それらの結果を統合して各ノードの特徴とします。

- 関係性(エッジ)の種類の考慮: リレーショナルデータベースでは、「顧客が商品を購入した」「従業員が上司に報告する」など、関係性(エッジ)自体が重要な意味を持ちます。Relational Graph Transformersは、エッジの種類に応じてアテンションの計算方法を変えるなど、エッジの持つ意味情報(セマンティクス)を学習に取り込みます。

- 時間情報の組み込み(Time Encoding): 多くのビジネスデータは時間とともに変化します(購買履歴、Webサイト訪問履歴など)。Relational Graph Transformersは、イベントが発生した時刻情報を「位置エンコーディング」の一種としてモデルに組み込み、時間の経過や順序関係を考慮した学習を可能にします。

- スケーラビリティへの対応: 数百万行、数十億の関係性を持つような巨大なデータベースに対応するため、グラフ全体を一度に処理するのではなく、関連性の深い部分グラフを抽出(サンプリング)して処理するなど、計算コストを抑える工夫がなされています。

5. 実験結果とその意義

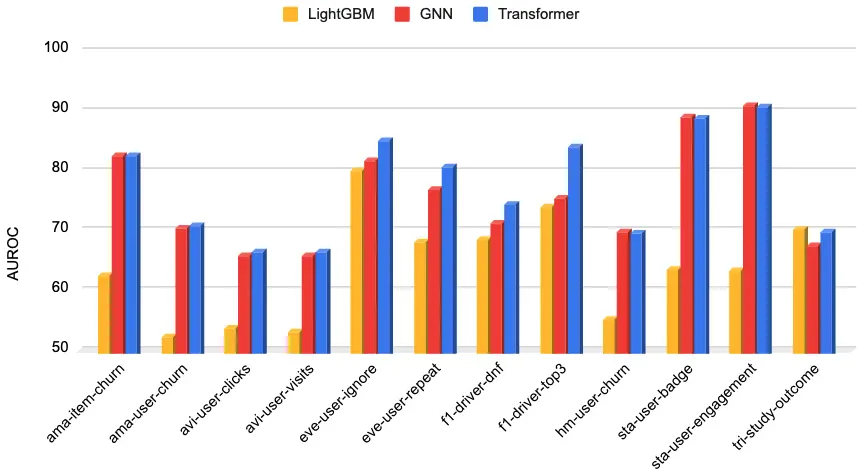

記事では、公開されているリレーショナルデータベースのベンチマーク(RelBench)を用いて、Relational Graph Transformersの性能評価が行われています。

- 結果として、従来のGNNと比較して平均約10%、古典的な機械学習モデル(LightGBM)と比較して40%以上の精度向上が確認されました。

- これは、Relational Graph Transformersが、特にノード間の長期的な依存関係(long-range dependencies)を捉える能力に優れていることを示唆しています。

- また、様々な種類の位置エンコーディング(ノードがグラフのどのあたりに位置するかを示す情報。ホップ数、ツリー構造、時間情報など)を組み合わせることで、モデルがグラフ構造をより深く理解できることも示されました。

まとめ

本稿では、リレーショナルデータベースから価値を引き出すための新しいAI技術「Relational Graph Transformers」について解説しました。

この技術は、データベースをグラフとして捉え、Transformerの強力なアテンションメカニズムを応用することで、従来の手法では困難だった複雑なデータ間の関係性を効率的かつ高精度に学習します。データ準備の手間を大幅に削減し、予測精度を向上させることで、企業は自社が持つデータ資産から、これまで以上に深い洞察を得ることが可能になります。

顧客分析、不正検知、推薦システムなど、その応用範囲は広く、今後のビジネスにおけるAI活用を大きく前進させる可能性を秘めた、注目すべき技術と言えるでしょう。