はじめに

OpenAIが2025年11月6日、AIの進歩状況と今後の展望、そして社会として取り組むべき推奨事項を発表しました。本稿では、この発表内容をもとに、AIが到達した現在地点、今後数年間で予測される技術発展、そしてその進歩を適切に導くために必要な取り組みについて解説します。

参考記事

- タイトル: AI progress and recommendations

- 発行元: OpenAI

- 発行日: 2025年11月6日

- URL: https://openai.com/index/ai-progress-and-recommendations/

・本稿中の画像に関しては特に明示がない場合、引用元記事より引用しております。

・記載されている情報は、投稿日までに確認された内容となります。正確な情報に関しては、各種公式HPを参照するようお願い致します。

・内容に関してはあくまで執筆者の認識であり、誤っている場合があります。引用元記事を確認するようお願い致します。

要点

- AIはチューリングテストを超え、最も困難な知的競技で人間の専門家を上回る性能を達成しているが、一般的な利用と技術的可能性の間には大きなギャップがある

- ソフトウェアエンジニアリング分野では、数秒で完了するタスクから1時間以上かかるタスクへと処理能力が進化し、同時にコストは年間40倍のペースで削減されている

- OpenAIは2026年に小規模な発見が可能になり、2028年以降にはより重要な発見ができるシステムの実現を見込んでいる

- OpenAIは、フロンティアラボ間での基準共有、公的監視の整備、AIレジリエンスエコシステムの構築、継続的な測定、個人のエンパワーメントという5つの推奨事項を提示した

詳細解説

AIが到達した現在地点と実用のギャップ

OpenAIによれば、現在のAIシステムは最も困難な知的競技において、人間の中でも最も優れた専門家を上回る性能を達成しています。チューリングテスト、つまりコンピュータが人間と区別がつかないレベルで会話できるかを測る基準は、長年にわたり到達困難な目標とされてきましたが、現在ではその段階を通過したと言えます。

ただし、OpenAIは重要な指摘をしています。世界の大多数の人々は依然としてAIをチャットボットや検索の改良版として捉えており、現在のAIが持つ能力と実際の利用方法との間には非常に大きなギャップが存在するとのことです。この指摘は、技術の進歩と社会での活用実態の乖離を示していると考えられます。

タスク処理能力の進化とコスト削減

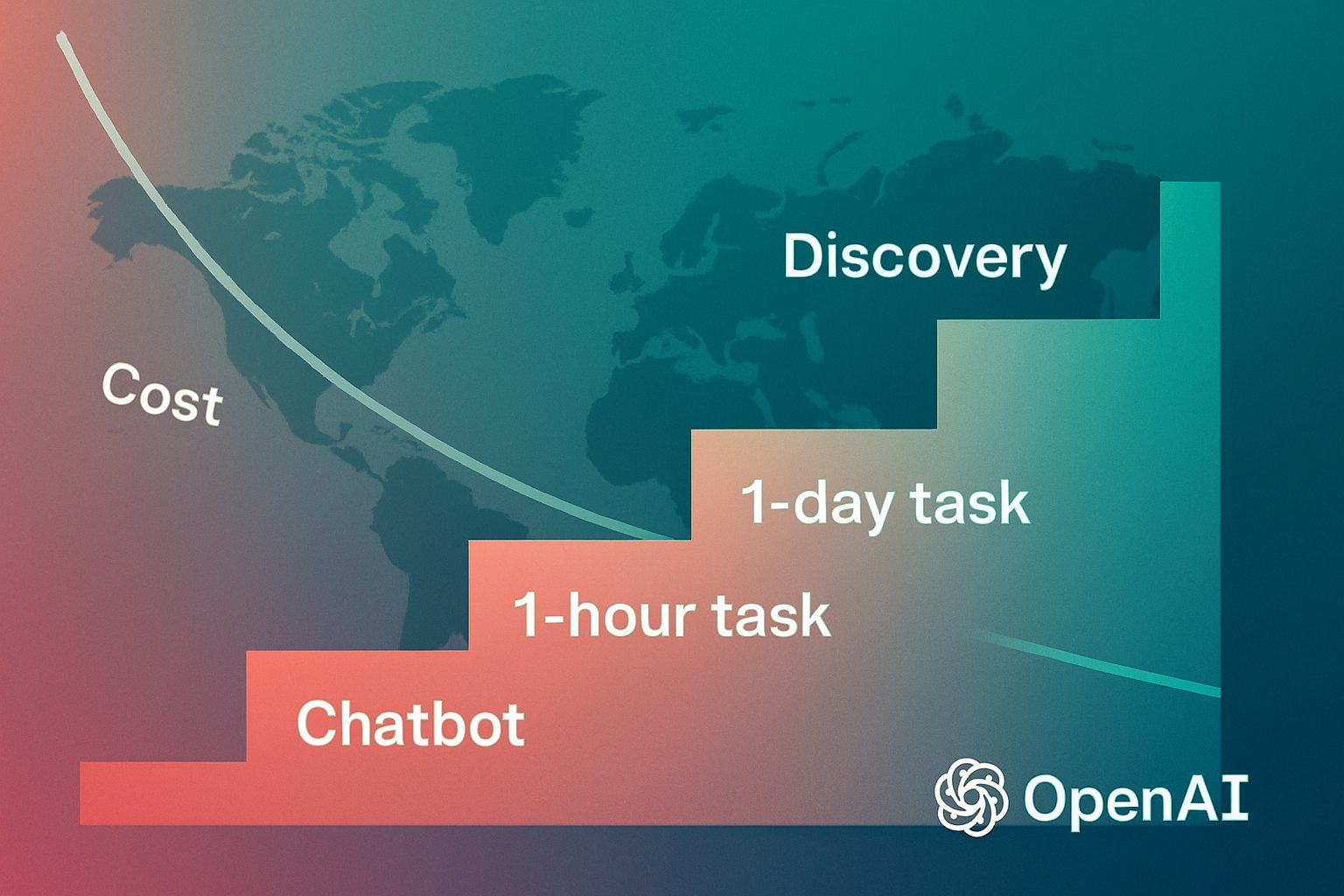

OpenAIは具体的な進歩の指標として、ソフトウェアエンジニアリング領域でのタスク処理能力の変化を挙げています。わずか数年前まで、AIは人間が数秒で完了できるタスクしか処理できませんでしたが、現在では1時間以上かかるタスクに対応できるようになりました。

さらに注目すべきは、OpenAIによれば、同じレベルの知能を得るためのコストが年間40倍のペースで低下しているという点です。この数値は過去数年間の実績に基づく推定値とされています。技術の高度化とコスト削減が同時に進行している状況は、AI活用の経済的ハードルが急速に下がっていることを示唆しています。

2026年から2028年へ:発見能力の獲得

OpenAIは今後の展望として、2026年には「very small discoveries(非常に小規模な発見)」が可能になり、2028年以降には「more significant discoveries(より重要な発見)」ができるシステムの実現を見込んでいます。ただし、この予測については「we could of course be wrong(もちろん間違っている可能性もある)」と留保しており、現在の研究進捗に基づく見通しであることが明示されています。

ここでいう「発見」とは、AIシステムが自律的に、あるいは人間の効果性を高めることで、新たな知識を生み出すことを指します。材料科学、創薬、気候モデリングといった分野での進展や、個別化された教育へのアクセス拡大などが具体例として挙げられています。

社会変化のペースに関する見解

OpenAIは、技術の急速な進歩にもかかわらず、日常生活は「surprisingly constant(驚くほど一定)」に感じられるだろうと予測しています。これは、人々の生活様式には大きな慣性があり、より優れたツールが利用可能になっても、すぐに生活が一変するわけではないという観察に基づいています。

一方で、OpenAIは仕事の性質が変化し、経済的な移行が困難を伴う可能性があることも認めています。さらに、「fundamental socioeconomic contract(基本的な社会経済契約)」の変更が必要になる可能性さえあると述べています。ただし、広く分配された豊かさの世界では、人々の生活は現在よりもはるかに良くなり得るという楽観的な展望も示されています。

安全性への取り組み

OpenAIは安全性(safety)を、AIのポジティブな影響を可能にしながらネガティブな影響を軽減する実践として定義し、深くコミットしていると述べています。超知能システムのリスクを「potentially catastrophic(潜在的に破滅的)」と位置づけ、安全性とアライメント(整合性)の実証的研究が、開発ペースの調整など世界的な意思決定に役立つと考えています。

特に、再帰的自己改善が可能なシステムに近づくにつれて、より慎重な研究が必要になる可能性があり、超知能システムを展開する前に、それらを確実に整合させ制御できることが必須だと強調しています。この領域では、さらなる技術的研究が必要とされています。

5つの推奨事項

OpenAIは、AIとのポジティブな未来を実現するために、以下の5つの推奨事項を提示しています。

1. フロンティアラボ間での基準と知見の共有

OpenAIは、最先端のAI研究を行う組織(フロンティアラボ)が、共通の安全原則に合意し、安全研究、新たなリスクに関する学び、競争のダイナミクスを減少させるメカニズムなどを共有すべきだと考えています。建築基準や防火基準が無数の命を救ってきたように、AI分野でも共通の基準が重要だとしています。

2. 能力に見合った公的監視とアカウンタビリティのアプローチ

OpenAIは、AIに関する2つの考え方を提示しています。1つは、AIを印刷機やインターネットのような「通常の技術」として扱い、従来の公共政策ツールで対応できるという見方です。現在のAIの能力レベルでは、ほとんどの開発者やオープンソースモデルに対して、既存の規制を超える追加的な負担を最小限にすべきだとしています。

もう1つは、超知能が人類が経験したことのない方法と速度で発展・拡散する可能性があるという見方です。この場合、各国の行政機関や安全研究所との緊密な協力が必要になり、特にバイオテロへのAI応用の軽減や自己改善型AIの影響について調整が求められるとしています。重要なのは公的機関へのアカウンタビリティであり、そこに到達する方法は過去とは異なる可能性があると述べています。

3. AIレジリエンスエコシステムの構築

OpenAIは、インターネットの登場時にサイバーセキュリティという分野全体が構築されたように、AI分野でも類似のエコシステムが必要だと主張しています。ソフトウェア、暗号化プロトコル、標準、監視システム、緊急対応チームなど、リスクを社会が許容できるレベルまで軽減する包括的な仕組みが求められます。この領域では、各国政府が産業政策を通じて重要な役割を果たすことができると考えられます。

4. フロンティアラボと政府による継続的な報告と測定

AIが実際に世界にどのような影響を与えているかを理解することで、技術をポジティブな影響に向けて導きやすくなります。OpenAIは、AIの雇用への影響など、予測が困難だった事例を挙げています。現在のAIの強みと弱みは人間のそれとは大きく異なるため、実際に何が起きているかを測定することが非常に有益だろうとしています。

5. 個人のエンパワーメントのための構築

OpenAIは、成人が社会によって定義された広範な枠組みの中で、自分自身の条件でAIを使用できるべきだと考えています。今後数年間で、高度なAIへのアクセスは電気、清潔な水、食料と同等の基本的なユーティリティになると予測されています。最終的には、社会がこれらのツールを広く利用可能にすることを支援し、人々が目標を達成できるよう支援することが指針となるべきだとしています。

まとめ

OpenAIは、AIが既にチューリングテストを超え、重要な知的課題で人間を上回る段階に到達していること、そして2028年頃には重要な発見が可能になる見通しを示しました。同時に、この技術の進歩を適切に導くために、フロンティアラボ間の協力、公的監視の整備、レジリエンスエコシステムの構築など、5つの具体的な推奨事項を提示しています。技術の急速な進歩と社会の適応のバランスをどう取るか、今後の展開が注目されます。