はじめに

OpenAIが2025年10月30日、GPT-5を活用したセキュリティエージェント「Aardvark」を発表しました。ソースコードの脆弱性を自動的に発見し、修正案まで提示する本格的なAIセキュリティツールです。本稿では、Aardvarkの仕組みと性能、実用化に向けた取り組みについて解説します。

参考記事

- タイトル: Introducing Aardvark: OpenAI’s agentic security researcher

- 発行元: OpenAI

- 発行日: 2025年10月30日

- URL: https://openai.com/index/introducing-aardvark/

・本稿中の画像に関しては特に明示がない場合、引用元記事より引用しております。

・記載されている情報は、投稿日までに確認された内容となります。正確な情報に関しては、各種公式HPを参照するようお願い致します。

・内容に関してはあくまで執筆者の認識であり、誤っている場合があります。引用元記事を確認するようお願い致します。

要点

- Aardvarkは、GPT-5を基盤とするエージェント型セキュリティツールであり、ソースコードの脆弱性を自動的に発見・評価・修正提案する

- ベンチマークテストでは既知の脆弱性の92%を検出し、高い検出精度を示した

- コミット監視、脆弱性の実証実験、自動パッチ生成という複数段階のパイプラインで動作する

- OpenAI内部およびアルファパートナーでの運用を経て、現在プライベートベータ版の参加者を募集中である

- オープンソースプロジェクトへの無償提供も計画されており、10件のCVE識別子を取得した脆弱性を発見・開示した実績がある

詳細解説

Aardvarkの基本コンセプト

OpenAIによれば、Aardvarkは「人間のセキュリティ研究者のように思考するAIエージェント」として設計されています。従来のファジングやソフトウェア構成分析といったプログラム解析手法には依存せず、LLMの推論能力とツール活用によってコードの動作を理解し、脆弱性を特定します。

ソフトウェアセキュリティの分野では、従来から自動化ツールが多数存在してきました。しかし、静的解析ツールは誤検出(false positive)が多く、動的解析ツールは実行環境の構築が必要という課題がありました。Aardvarkは、コードを読み、分析し、テストを実行するという人間の研究者に近いアプローチを採用することで、これらの課題に対応しようとしています。

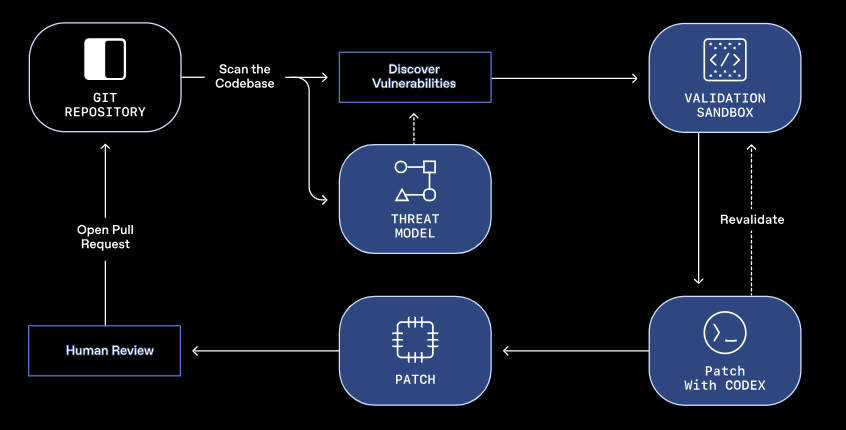

4段階のパイプライン

OpenAIの発表では、Aardvarkは以下の4段階で動作すると説明されています。

第一段階の分析フェーズでは、リポジトリ全体を解析し、プロジェクトのセキュリティ目標と設計を反映した脅威モデルを作成します。脅威モデルとは、システムに対する潜在的な攻撃経路や保護すべき資産を整理したものです。この段階で、Aardvarkはプロジェクトの全体像を把握します。

第二段階のコミットスキャンでは、新しいコードがコミットされるたびに、そのコミット内容をリポジトリ全体および脅威モデルと照らし合わせて脆弱性を検査します。新規接続されたリポジトリでは、過去のコミット履歴も遡ってスキャンするとのことです。Aardvarkは発見した脆弱性について、コードに注釈を付けながら段階的に説明を提供します。

第三段階の検証フェーズが、Aardvarkの特徴的な機能の一つです。OpenAIによれば、潜在的な脆弱性を特定した後、隔離されたサンドボックス環境で実際にその脆弱性を再現し、悪用可能性を確認します。この実証実験により、誤検出を減らし、実際に悪用可能な脆弱性のみを報告できるとされています。セキュリティ分野では、理論的には脆弱性でも実際には悪用が困難なケースが多く、この検証ステップは実用性の向上に寄与すると考えられます。

第四段階のパッチ生成では、OpenAI Codexと統合し、発見した脆弱性の修正案を自動生成します。各発見事項には、Codexが生成しAardvarkがスキャンしたパッチが添付され、人間によるレビューとワンクリックでのパッチ適用が可能になっています。

実績と性能

OpenAIの発表では、Aardvarkは数ヶ月間にわたってOpenAI内部のコードベースおよび外部アルファパートナーのコードベースで継続的に稼働してきました。OpenAI内部では意味のある脆弱性を発見し、同社の防御態勢に貢献したとのことです。パートナーからは分析の深さが評価され、複雑な条件下でのみ発生する問題も発見できたとされています。

ベンチマークテストにおいて、Aardvarkは既知および人工的に導入された脆弱性の92%を検出したと報告されています。この数値は、高いリコール率(見逃しの少なさ)と実世界での有効性を示すものです。一般的なセキュリティツールの評価では、検出率と誤検出率の両方が重要な指標となります。92%という検出率は、既存の自動化ツールと比較しても高水準と言えるでしょう。

また、オープンソースプロジェクトへの適用では、10件のCVE識別子を取得した脆弱性を発見し、責任ある開示を行ったとのことです。CVE(Common Vulnerabilities and Exposures)は、公開された脆弱性に付与される標準的な識別番号であり、セキュリティコミュニティで広く参照されます。

オープンソースへの貢献と開示ポリシー

OpenAIは、オープンソースプロジェクトへの無償スキャン提供を計画しています。同社は「数十年にわたるオープンな研究と責任ある開示の恩恵を受けてきた」として、デジタルエコシステム全体の安全性向上に貢献する姿勢を示しています。

この発表に先立ち、OpenAIはアウトバウンド調整開示ポリシーを更新しました。このポリシーは、開発者にとって友好的なアプローチを採用しており、厳格な開示期限ではなく、協力とスケーラブルな影響に焦点を当てているとのことです。Aardvarkのようなツールが多数の脆弱性を発見することが予想されるため、開発者に過度な圧力をかけずに長期的な耐性を実現する協力体制を目指しています。

従来の脆弱性開示では、発見から一定期間後に公開するという時間制限が設けられることが多く、開発者にとって対応の負担となる場合がありました。OpenAIのアプローチは、この課題に配慮したものと考えられます。

プライベートベータと今後の展開

OpenAIによれば、Aardvarkは現在プライベートベータ段階にあり、参加組織を募集しています。参加要件として、GitHub Cloud統合、測定とフィードバックへのコミットメント、OpenAIのポリシー遵守が挙げられています。

ベータプログラムの目的は、さまざまな環境での性能検証、検出精度の改善、検証ワークフローの洗練、報告体験の向上などです。OpenAIは、セキュリティ専門知識へのアクセス拡大を目指しており、プライベートベータでの学習を経て、より広範な提供を計画しています。

OpenAIの発表では、2024年だけで40,000件以上のCVEが報告されたと述べられています。また、同社のテスト結果では、コミットの約1.2%がバグを導入しているとのことです。これらの数値は、ソフトウェアセキュリティが抱える規模の大きさを示しており、自動化ツールの必要性を裏付けています。

Aardvarkは、コードの進化に伴って継続的な保護を提供する「ディフェンダーファースト」のモデルとして位置づけられています。脆弱性を早期に発見し、実世界での悪用可能性を検証し、明確な修正案を提供することで、イノベーションを妨げることなくセキュリティを強化できるとされています。

・Aardvarkプライベートベータ版関心フォーム:https://openai.com/form/aardvark-beta-signup

まとめ

OpenAIのAardvarkは、GPT-5を活用してソースコードの脆弱性を自動的に発見・検証・修正提案するセキュリティエージェントです。92%の高い検出率を記録し、プライベートベータでの実証を経て、オープンソースコミュニティへの貢献も視野に入れています。セキュリティ専門家の不足が課題となる中、こうしたAIツールがどこまで実用的な支援を提供できるか、今後の展開が注目されます。