はじめに

本稿では、Google公式ブログ「Building with AI: highlights for developers at Google I/O」をもとに、Google I/O 2025の内容を解説していきます。

引用元記事

- タイトル: Building with AI: highlights for developers at Google I/O

- 発行元: Google

- 発行日: 2025年5月20日

- URL: https://blog.google/technology/developers/google-ai-developer-updates-io-2025/

要点

- Google I/O 2025において、開発者向けにAI関連の多数の新機能や新モデルが発表された。

- 主力モデルであるGemini 2.5 Flash Previewが強化され、コーディング能力や複雑な推論能力が向上し、速度と効率も最適化された。

- Gemma 3n(高速なオープンマルチモーダルモデル)、Gemini Diffusion(超高速テキストモデル)、Lyria RealTime(インタラクティブ音楽生成モデル)といった多様なニーズに応える新しいモデル群が発表された。

- 医療分野向けのMedGemmaや手話翻訳を可能にするSignGemmaなど、特定の用途に特化したGemmaファミリーのバリアントも登場した。

- Colabの新機能、一般提供が開始されたGemini Code Assist、Firebase Studio、Jules、Stitchなど、AIアプリケーション開発を効率化し、容易にするための革新的なツール群が紹介された。

- Gemini APIに関しても、Google AI Studioのアップデート、ネイティブオーディオ出力&ライブAPI、ネイティブオーディオダイアログ(TTS)、非同期関数呼び出し、コンピュータ使用API、URLコンテキスト、モデルコンテキストプロトコル(MCP)サポートなど、多数の機能強化が行われた。

- これらの発表は、AI開発のハードルを下げ、より多くの開発者が革新的なAIアプリケーションを構築できるよう支援することを目的としている。

詳細解説

今回のGoogle I/Oでは、AIが開発のあらゆる場面で中心的な役割を担う未来を強く意識させる発表が相次ぎました。特に注目すべきは、Googleの最先端AIモデル「Gemini」ファミリーの進化と、開発を支援する新しいツール群です。

Geminiモデルの進化:より賢く、より速く、より多様に

AIの中核となるのが「モデル」です。これは、大量のデータで訓練された、いわばAIの脳みそのようなものです。Googleは今回、主力モデルであるGeminiのアップデートと、新たなモデルを発表しました。

Gemini 2.5 Flash Previewの強化

「Gemini 2.5 Flash」は、Googleの提供するモデルの中でも特に速度と効率に最適化された軽量版モデルです。今回のアップデートでは、コーディング能力(プログラムコードの理解や生成)と複雑な推論タスク(複数の情報を組み合わせて論理的な結論を導き出す能力)のパフォーマンスがさらに向上しました。

また、透明性と制御の向上も図られています。「思考サマリー」機能により、モデルがどのように結論に至ったかの概要を開発者が確認できるようになりました。さらに、「思考バジェット」という機能も近日中に「Gemini 2.5 Pro Preview」(Flashより高性能なモデル)に導入予定で、これにより開発者はコストを管理しつつ、モデルが応答を生成する前にどの程度「考える」かを制御できるようになります。これは、AIの応答の質とコストのバランスを取る上で非常に重要な機能です。

これらのモデルは、Google AI StudioやVertex AI(Google Cloudの機械学習プラットフォーム)でプレビュー版として利用可能で、Flashは6月上旬、Proもその後すぐに一般提供が開始される予定です。

多様なニーズに応える新しいモデル群

Gemma 3n:

「Gemma」はGoogleが開発したオープンモデル(モデルの構造や重みが公開されており、比較的自由に利用・改変できるモデル)のファミリーです。新しく発表された「Gemma 3n」は、高速かつ効率的なオープンマルチモーダルモデルです。「マルチモーダル」とは、テキストだけでなく、音声、画像、動画といった複数の種類の情報を扱えることを意味します。このモデルはスマートフォンやラップトップ、タブレットといったデバイス上でもスムーズに動作するように設計されており、より身近な環境で高度なAI機能を利用できるようになります。

Gemini Diffusion:

これは非常に高速な新しいテキストモデルです。Googleによると、実験的なデモでは、既存の最速モデルと比較して5倍の速度でテキストを生成しつつ、コーディング性能は同等レベルを維持しているとのことです。迅速な応答が求められるアプリケーションでの活用が期待されます。

Lyria RealTime:

音楽制作のあり方を変える可能性を秘めた、実験的なインタラクティブ音楽生成モデルです。ユーザーはリアルタイムで音楽を対話的に作成、制御、演奏することができます。Gemini APIを通じて利用可能で、Google AI Studioのスターターアプリで試すことができます。

Gemmaファミリーの特定用途向けバリアント

MedGemma:

医療分野に特化したオープンモデルで、マルチモーダルな医療テキストと画像の理解に優れています。開発者はこのモデルを基に、例えば医療画像の分析支援など、独自のヘルスケアアプリケーションを構築できます。

SignGemma:

手話を話し言葉のテキストに翻訳することを目的とした、近日公開予定のオープンモデルです。特にアメリカ手話(ASL)から英語への翻訳に優れており、聴覚に障がいを持つ方々のための新しいアプリケーションやインテグレーション開発を可能にします。

AI開発を加速する革新的なツール群

優れたモデルがあっても、それを活用してアプリケーションを開発するためのツールがなければ宝の持ち腐れです。Googleは、AI開発のハードルを下げ、生産性を向上させるための新しいツールも多数発表しました。

新しい、よりエージェント的なColab

「Colaboratory(Colab)」は、ブラウザ上でPythonコードを実行できる人気の開発環境です。これが近々、完全にエージェント的な体験を提供するようになります。「エージェント的」とは、AIがより自律的にタスクを実行することを意味します。開発者はColabに達成したい目標を伝えるだけで、Colabがノートブック内で必要なアクション(エラー修正やコード変換など)を自動的に行い、複雑な問題の解決を支援してくれるようになります。

Gemini Code Assistの一般提供開始

「Gemini Code Assist」は、AIによるコーディング支援ツールです。個人開発者向けの無料版と、GitHubと連携するコードレビューエージェント機能が、一般提供開始となりました。

さらに、Gemini Code AssistはGemini 2.5モデルを搭載するようになり、より高度な支援が可能になります。特筆すべきは、Vertex AIで利用可能になった際に、Gemini Code Assist StandardおよびEnterpriseの利用者は200万トークンという非常に大きなコンテキストウィンドウを利用できるようになる点です。「コンテキストウィンドウ」とは、AIが一度に処理・記憶できる情報量を指し、これが大きいほど、より長く複雑なコードや文脈を理解し、適切な支援を提供できます。

Firebase Studio: フルスタックAIアプリ開発を容易に

「Firebase」は、モバイルアプリやウェブアプリの開発を支援するGoogleのプラットフォームです。新しく発表された「Firebase Studio」は、クラウドベースのAIワークスペースで、アイデアをフルスタック(フロントエンドからバックエンドまで全てを含む)のAIアプリケーションへと容易に具現化できるようにします。

特筆すべき機能として、デザインツール「Figma」で作成したデザインをbuilder.ioプラグインを使ってFirebase Studioに直接取り込み、アプリとして生命を吹き込むことができます。また、アプリが必要とするバックエンド(サーバー側の処理やデータベースなど)を自動的に検出し、プロビジョニング(準備・設定)してくれる機能も順次展開されます。

Jules: 非同期コーディングエージェント

「Jules」は、開発者が本来集中したいコーディング作業に専念できるよう、細々としたタスクを代わりに引き受けてくれる非同期コーディングエージェントです。例えば、バグ修正のバックログ処理、複数のタスクの同時処理、さらには新機能の初期的な骨組み構築などを任せることができます。JulesはGitHubと直接連携し、リポジトリをクラウド上の仮想マシンに複製して作業を行い、準備ができたらプルリクエスト(変更内容の提案)を作成してくれます。

Stitch: AIによるUIデザインとコード生成

「Stitch」は、自然言語による説明や画像プロンプト(指示画像)に基づいて、高品質なUI(ユーザーインターフェース)デザインと、それに対応するフロントエンドコード(HTML/CSSなど)を生成する新しいAIツールです。これにより、開発者はアイデアを驚くほど迅速に形にすることができます。対話形式でデザインを調整したり、テーマを変更したり、作成したものをCSS/HTMLやFigmaにエクスポートしてさらに作業を続けることも容易です。

Gemini APIの進化:より高度な連携と制御

「API(Application Programming Interface)」は、ソフトウェアやプログラム同士が情報をやり取りするための窓口となるものです。Gemini APIを通じて、開発者は自身のアプリケーションにGeminiモデルの強力なAI機能を組み込むことができます。今回のI/Oでは、このGemini APIにも多くのアップデートがありました。

- Google AI Studioのアップデート

- 「Google AI Studio」は、Gemini APIを使った開発を最も迅速に始められる場所です。最先端のGemini 2.5モデルに加え、画像生成AI「Imagen」や動画生成AI「Veo」といった新しい生成メディアモデル、ネイティブ画像生成機能などが利用可能になりました。

- また、Google AI StudioのネイティブコードエディタにGemini 2.5 Proが統合され、プロトタイピング(試作品開発)がより高速に行えるようになりました。GenAI SDK(生成AI用ソフトウェア開発キット)と緊密に最適化されており、テキスト、画像、動画のプロンプトから即座にウェブアプリを生成することも可能です。

- ネイティブオーディオ出力&ライブAPI

- プレビュー版として提供される新しいGemini 2.5 Flashモデルには、いくつかの新機能が含まれています。

- プロアクティブビデオ: モデルが動画内の重要なイベントを検出し記憶する機能。

- プロアクティブオーディオ: モデルが無関係な音声信号には応答しないように選択する機能。

- 感情ダイアログ: モデルがユーザーの口調(トーン)に応じて応答を変化させる機能。

- プレビュー版として提供される新しいGemini 2.5 Flashモデルには、いくつかの新機能が含まれています。

- ネイティブオーディオダイアログ (TTS)

- 開発者は、Gemini 2.5 Flashおよび2.5 Proの新しいテキスト読み上げ(TTS: Text-to-Speech)機能のプレビューを利用できるようになります。これにより、単一または複数の話者による洗練された音声出力を生成できます。新しい制御可能なTTSモデルでは、開発者は音声のスタイル、アクセント、ペースを正確に指示でき、高度にカスタマイズされたAI生成オーディオを作成できます。

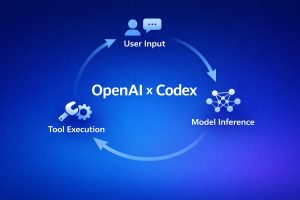

- 非同期関数呼び出し

- この新機能により、実行に時間のかかる関数やツールを、メインの対話フローをブロックすることなくバックグラウンドで呼び出すことが可能になります。これにより、ユーザー体験を損なうことなく、より複雑な処理をAIアプリケーションに組み込めます。

- コンピュータ使用API

- 開発者が、ユーザーの指示に基づいてウェブを閲覧したり、他のソフトウェアツールを使用したりできるアプリケーションを構築するための新しいAPIです。現在はGemini APIの信頼できるテスター向けに提供されており、年内にさらに多くの開発者に展開される予定です。これは、AIがより能動的にコンピュータを操作し、ユーザーを支援する未来を示唆しています。

- URLコンテキスト

- URLから完全なページコンテキスト(ページ全体の情報)を取得する実験的な新ツールのサポートが追加されます。単独で使用することも、Google検索のような他のツールと組み合わせて使用することも可能です。これにより、AIはウェブページの内容をより深く理解し、関連性の高い情報を提供できるようになります。

- モデルコンテキストプロトコル (MCP) のサポート

- Gemini APIとSDKがモデルコンテキストプロトコル(MCP)をサポートすることが発表されました。これにより、開発者は幅広いオープンソースツールを容易に利用できるようになります。エコシステムの拡大と柔軟な開発環境の提供を目指すものです。

まとめ

今回のGoogle I/O 2025で発表されたAI関連のアップデートは、開発者にとって非常にエキサイティングな内容でした。Geminiモデルの進化は、より高度で効率的なAIアプリケーションの実現を可能にし、Gemmaファミリーの拡充は、特定のニーズに合わせた柔軟なモデル選択を提供します。さらに、Colab、Gemini Code Assist、Firebase Studio、Jules、Stitchといった革新的な開発ツール群は、アイデアの具現化を加速し、開発プロセスそのものを変革する可能性を秘めています。Gemini APIの機能強化も、AIをアプリケーションに統合する際の柔軟性と制御性を大幅に向上させるものです。 これらの技術は、単に便利なツールというだけでなく、AIと共に新しい価値を創造していくための強力なパートナーとなるでしょう。