はじめに

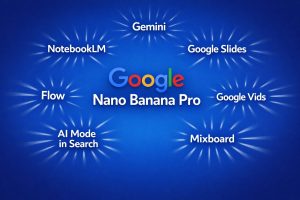

Googleが2025年11月18日、新世代AIモデル「Gemini 3」を発表しました。最も賢いモデルと位置づけられるGemini 3は、GeminiアプリとGoogle Searchの両方に統合され、高度な推論能力と動的なUI生成機能を提供します。本稿では、公式ブログの発表内容をもとに、Gemini 3の性能向上、新機能、実用的な活用方法について解説します。

参考記事

メイン記事:

- タイトル: Gemini 3 brings upgraded smarts and new capabilities to the Gemini app

- 著者: Josh Woodward

- 発行元: Google Blog

- 発行日: 2025年11月18日

- URL: https://blog.google/products/gemini/gemini-3-gemini-app/

関連情報:

- タイトル: Google Search with Gemini 3: Our most intelligent search yet

- 著者: Elizabeth Hamon Reid

- 発行元: Google Blog

- 発行日: 2025年11月18日

- URL: https://blog.google/products/search/gemini-3-search-ai-mode/

・本稿中の画像に関しては特に明示がない場合、引用元記事より引用しております。

・記載されている情報は、投稿日までに確認された内容となります。正確な情報に関しては、各種公式HPを参照するようお願い致します。

・内容に関してはあくまで執筆者の認識であり、誤っている場合があります。引用元記事を確認するようお願い致します。

※性能について詳しく知りたいかは以下を参照してください。

要点

- Gemini 3は、高度な推論能力を備えたGoogleの最新AIモデルで、GeminiアプリとGoogle Searchの両方に統合された

- 「Generative Interfaces」により、プロンプトに応じて動的にUIを生成し、Visual LayoutとDynamic Viewの2つの実験的機能を提供する

- Gemini Agentは、複数ステップのタスクを自動化する実験的機能で、Gmail、Calendarなどと連携してメール整理やスケジュール管理を実行できる

- Google SearchのAI Modeでは、Gemini 3の推論能力を活用したquery fan-out技術の強化により、より関連性の高いコンテンツを発見できる

- Generative UIは、物理シミュレーションやローン計算機など、プロンプトに応じてインタラクティブなツールを自動生成する

詳細解説

Gemini 3の基本性能と展開

Googleによれば、Gemini 3はAIモデルのパフォーマンスにおいて新しい基準を設定するモデルです。応答がより役立つように改善され、フォーマットが整理され、簡潔になったと説明されています。

Gemini 3 Proは、Geminiアプリのモデル選択から「Thinking」を選択することで利用できます。Google AI Plus、Pro、Ultraのサブスクライバーは、より高い利用制限を享受できます。また、米国の大学生には1年間の無料Google AI Proが提供され、Gemini 3へのアクセスが確保されます。

Google Searchでは、AI Modeを通じてGemini 3 Proが利用可能になりました。これは、Geminiモデルが発表当日にSearchに統合された初めてのケースです。米国のGoogle AI ProおよびUltraサブスクライバーは、AI Modeのモデルドロップダウンメニューから「Thinking」を選択することで利用できます。

AIモデルの評価において、推論能力は複雑な問題を段階的に分析する能力を指します。Gemini 3は、この推論能力を強化することで、より深い理解と正確な応答を可能にしていると考えられます。

マルチモーダル理解とvibe coding

Googleの発表では、Gemini 3は世界最高のマルチモーダル理解モデルとされています。これは、テキスト、画像、音声など複数の形式のデータを統合的に理解する能力を意味します。宿題の写真をアップロードして追加のヘルプを求めたり、欠席した講義のノートを文字起こししたりする場面で活用できます。

さらに、Gemini 3は「vibe coding」において最高のモデルと位置づけられています。Canvasで構築するアプリは、より多機能になるとされています。vibe codingとは、自然言語での指示からコードを生成する能力を指すと考えられ、開発者が直感的な表現でアプリケーションを構築できる可能性を示しています。

マルチモーダル理解の向上は、AI開発における重要なトレンドです。従来のテキストのみのモデルと比較して、実世界の複雑な状況をより正確に理解できる利点があります。

Generative Interfaces:動的UI生成の実現

Gemini 3の推論能力とマルチモーダル機能により、「Generative Interfaces」という新しい機能が実現されました。これは、プロンプトの瞬間にモデルが生成するインターフェースで、ユーザーのニーズに適応します。

最初の2つの実験として、Visual LayoutとDynamic Viewが提供されます。Visual Layoutは、写真とモジュールを含む没入型の雑誌スタイルのビューを生成します。これらの要素は視覚的に優れているだけでなく、結果をさらにカスタマイズするための入力を促します。例えば、「来年の夏にローマへの3日間の旅行を計画して」と尋ねると、実際に探索できる視覚的な旅程が得られます。

Dynamic Viewは異なるアプローチを取り、Gemini 3のagentic coding能力を使用します。Geminiはプロンプトに完全に適合したカスタムユーザーインターフェースをリアルタイムで設計しコーディングします。例えば、「各作品のライフコンテキストを含むVan Gogh Galleryを説明して」と尋ねると、タップ、スクロール、学習を可能にする美しいインタラクティブな応答が得られます。

従来のWeb UIは、開発者が事前に設計した固定的な構造でしたが、Generative Interfacesは各ユーザーの質問に応じて動的に最適なUIを生成する点で革新的です。ただし、実験的機能であるため、ユーザーフィードバックをもとに改善が進められる段階と考えられます。

Gemini Agent:複数ステップのタスク自動化

Gemini Agentは、Gemini内で複数ステップのタスクを直接処理する実験的機能です。Googleアプリに接続して、カレンダーの管理、リマインダーの追加、または「受信トレイを整理して」と依頼するだけで、ToDoの優先順位付けと承認用の返信の下書きを作成します。

具体的な指示も可能です。例えば、「来週の旅行のために詳細を使って1日80ドル未満の中型SUVを調査して予約を手伝って」と依頼すると、Geminiはフライト情報を特定し、予算内のレンタルを比較し、予約を準備します。

Project Marinerからの洞察に基づいて構築され、Gemini 3の高度な推論能力を活用しているとされています。Gemini Agentは、Deep Research、Canvas、GmailやCalendarなどのGoogle Workspace接続アプリ、ライブWebブラウジングなどのツールを使用して複雑なリクエストを分解します。使用時にはユーザーが制御を維持し、Geminiは購入やメッセージ送信などの重要なアクションの前に確認を求めるように設計されています。この機能は、米国のGoogle AI Ultraサブスクライバー向けにWeb上で提供されます。

自動化エージェントは、RPA(Robotic Process Automation)の進化形として位置づけられます。従来のRPAが事前定義されたルールに従うのに対し、AIエージェントは状況を理解して柔軟に対応できる点が特徴です。ただし、重要な判断では人間の確認を求める設計は、現在のAI技術の信頼性を考慮した慎重なアプローチと言えるでしょう。

Google SearchにおけるGemini 3の統合

Google SearchのAI Modeでは、Gemini 3の高度な推論能力により、前例のない深さとニュアンスを把握できるとされています。query fan-out技術が大幅にアップグレードされ、関連するWebコンテンツを発見するためにさらに多くの検索を実行できるだけでなく、Geminiがユーザーの意図をより賢く理解することで、以前は見逃していた新しいコンテンツを見つけることができます。

query fan-out技術とは、1つのユーザークエリを複数の関連クエリに展開して検索する手法です。これにより、より包括的な情報収集が可能になります。Gemini 3の推論能力の向上により、この展開がより適切になったと考えられます。

数週間後には、SearchでのGemini 3による自動モデル選択も強化されます。これは、AI ModeとAI Overviewsで最も困難な質問をこのフロンティアモデルにインテリジェントにルーティングし、単純なタスクには引き続き高速モデルを使用することを意味します。

この段階的なモデル選択は、コスト効率と応答速度のバランスを取る実用的なアプローチです。すべてのクエリに最大のモデルを使用するのではなく、複雑さに応じて適切なモデルを選択する戦略は、商用サービスの運用において重要な考慮点と言えます。

SearchにおけるGenerative UI

Gemini 3のマルチモーダル理解とagentic coding能力により、よりカスタマイズされた生成的ユーザーインターフェースが実現されます。AI ModeのGemini 3は、インタラクティブなツールとシミュレーションを特徴とする応答の理想的な視覚的レイアウトを動的に作成できます。

具体的には、Gemini 3がユーザーの質問を分析し、画像、表、グリッドなどの視覚的要素を含むカスタム応答を構築して、最も役立つレイアウトを作成します。モデルがインタラクティブなツールがトピックの理解に役立つと検出すると、生成機能を使用してカスタムシミュレーションまたはツールをリアルタイムでコーディングし、応答に追加します。

例として、三体問題の背後にある物理学を学んでいる場合、読むだけでなく、変数を操作して重力相互作用が展開するのを見ることができるインタラクティブなシミュレーションを取得できます。または、住宅ローンを調査している場合、AI ModeのGemini 3は、応答内に直接カスタムビルトのインタラクティブなローン計算機を作成し、2つの異なるオプションを比較して、どちらが最も長期的な節約を提供するかを確認できます。

この機能は、Googleの生成的UI研究に基づいていると説明されています。静的なテキストや画像だけでなく、インタラクティブなツールを動的に生成することで、ユーザーの理解を深める新しいアプローチです。

教育分野や複雑な意思決定支援において、このような動的なツール生成は有用と考えられます。ただし、生成されたシミュレーションやツールの正確性を検証する仕組みも重要になるでしょう。

新しいデザインとショッピング体験

Geminiアプリは、この新時代を迎えるために、クリーンでモダンな外観で再設計されました。チャットの開始が容易になり、新しい「My Stuff」フォルダで作成した画像、ビデオ、レポートを見つけやすくなりました。

ショッピング体験も大幅に改善され、500億を超える製品リストを含むGoogleのShopping Graphから、製品リスト、比較表、価格を直接提供します。これにより、ユーザーは複数のサイトを訪問することなく、Gemini内で製品情報を比較検討できる可能性があります。

まとめ

Gemini 3は、高度な推論能力とマルチモーダル理解を備えた新世代のAIモデルとして、GeminiアプリとGoogle Searchの両方に統合されました。動的UI生成機能であるGenerative Interfacesは、各ユーザーの質問に応じて最適なインターフェースを自動生成し、インタラクティブなツールやシミュレーションを提供します。Gemini Agentによる複数ステップのタスク自動化は、実験的段階ながらAIアシスタントの新しい可能性を示しています。これらの機能が今後どのように改善され、実用的な価値を提供していくか注目されます。