はじめに

AI技術は日々進化を続けていますが、その最前線を走るGoogle DeepMindのCEO、デミス・ハサビス氏が、同社のAIモデルGenie 2の驚くべき能力をデモンストレーションし、その将来的な意義について語りました。Genie 2は2024年12月には発表されていた技術ですが、今回のハサビス氏による解説は、AIが現実世界をどのように理解し、応用されていくのか、具体的なビジョンを示唆するものです。

本稿では、CBS Newsの報道に基づき、ハサビスCEOの視点を通じて、Genie 2の可能性と、それが私たちの未来にどのような影響を与えうるのかを、分かりやすく解説していきます。

引用元情報

- タイトル: Google DeepMind CEO demonstrates Genie 2, world-building AI model that could train robots

- 発行元: CBS News

- 発行日: 2025年4月20日

- URL: https://www.cbsnews.com/news/google-deepmind-ceo-demonstrates-genie-2-world-building-ai-model-60-minutes/

Genie2: https://deepmind.google/discover/blog/genie-2-a-large-scale-foundation-world-model

・本稿中の画像に関しては特に明示がない場合、引用元記事より引用しております。

・記載されている情報は、投稿日までに確認された内容となります。正確な情報に関しては、各種公式HPを参照するようお願い致します。

・内容に関してはあくまで執筆者の認識であり、誤っている場合があります。引用元記事を確認するようお願い致します。

要点

- Google DeepMind CEOのデミス・ハサビス氏が、AIモデルGenie 2(1枚の静止画像から操作可能な3D仮想世界を生成する技術)のデモンストレーションを行いました。

- ハサビス氏は、Genie 2の主な目的はエンターテイメント応用だけでなく、AIが現実世界を理解するための「世界モデル」構築にあると強調しました。

- 特にロボット工学分野において、Genie 2が生成するシミュレーション環境が、効率的かつ安全なAIトレーニングに不可欠であるとの見解を示しました。

- 将来的には、GoogleのStreet Viewなどの現実世界のデータを活用し、AIの理解力をさらに深める可能性にも言及しました。

詳細解説

Genie 2とは? – CEOが示した「画像から世界を創造する魔法」

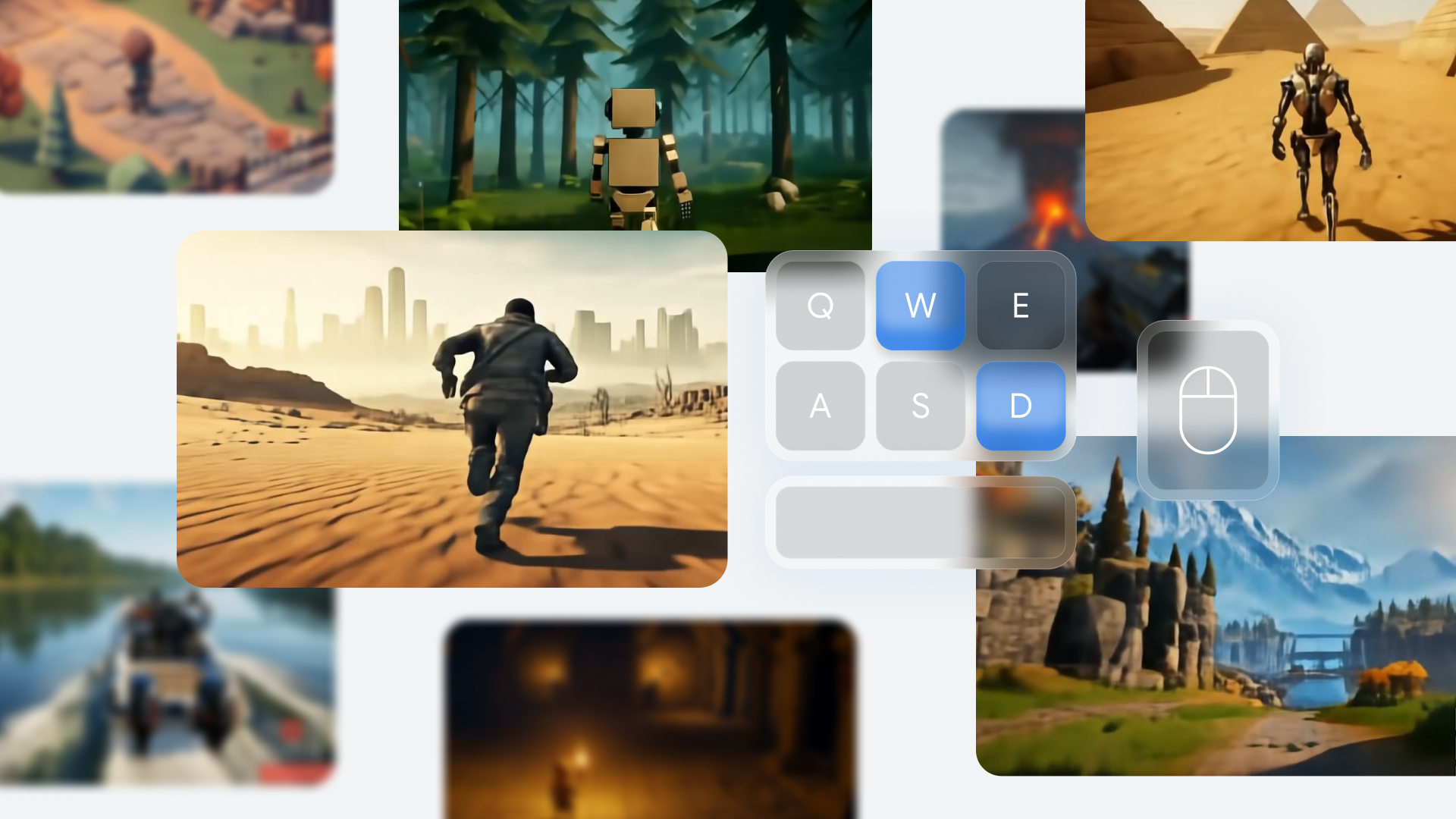

今回ハサビス氏らがデモンストレーションしたGenie 2は、「生成AI」の一種で、たった1枚の写真やイラストから、インタラクティブな3D環境を構築する能力を持ちます。デモでは、風景写真がまるで一人称視点のビデオゲームのように、自由に探索できる仮想空間へと変換されました。プレイヤーが移動すると、元の写真にはなかった景色がAIによってリアルタイムに生成(on the fly)されます。これはAIが画像の文脈を理解し、「次に何が見えるはずか」を推測・生成していることを示しています。

なぜ仮想世界を作るのか? – ハサビスCEOが語る「世界モデル」の重要性

ハサビス氏はこの技術について、単なるゲームや映像生成ツールとしてだけでなく、より大きな目標があると強調します。それは「世界モデル(world model)」、すなわちAIが私たちの住む現実世界を理解するための基盤を構築することです。人間が経験から物理法則などを自然に理解するように、AIにも同様の理解力を持たせることが、より高度なタスク遂行の鍵となります。

ロボット訓練のブレークスルーへ – シミュレーションの価値

ハサビス氏が特に大きな可能性を見出しているのが、ロボットのトレーニングへの応用です。氏は、「現実世界でのデータ収集ははるかに困難で、コストも時間もかかる(much harder to collect data in the real world, much more expensive, much slower)」と指摘します。特にロボット工学のデータ収集は大変です。

しかし、Genie 2が生成する精巧なシミュレーション環境(仮想世界)であれば、AI(シミュレーション内のロボット)は安全かつ高速に、ほぼ無限に近い試行錯誤を行えます。「まずシミュレーション世界で学習し、最後に少量の現実世界のデータで微調整(fine tune)する」ことで、効率的に高性能なロボットAIを開発できるとハサビス氏は説明します。

さらなる可能性 – Googleのデータ資産との連携

ハサビス氏は、Googleが保有する膨大な地理空間データ(Google Earth, Maps, Street View)の活用にも言及しました。「現在、まさに検討しているのは…Street Viewのようなデータを活用し、我々のAIシステムに現実世界や地理空間の理解を与えることです(That’s what we’re exploring at the moment actually… potentially using Street View kind of data to give real-world understanding and geographical understanding to our AI systems)」と述べ、これによりAIの現実世界に対する理解(real-world understanding)を深める可能性を示唆しました。将来的には、旅行の写真やStreet Viewの画像が、インタラクティブに探索できる3D空間になるかもしれません。

背景にある技術の進歩

今回のGenie 2のデモンストレーションは、Google DeepMindにおけるAI技術全体の急速な進歩を示す一例です。同記事では、視覚・聴覚を持つAIアシスタントAstraや、高品質な動画を生成するVeo 2なども紹介されており、同社のAI開発が多角的に進んでいることがうかがえます。

まとめ

本稿では、Google DeepMind CEO デミス・ハサビス氏によるGenie 2のデモンストレーションと、氏が語ったその意義について解説しました。Genie 2は、単に画像から3D世界を生成するだけでなく、AIが現実世界を理解するための「世界モデル」構築という、より大きな目標に向けた重要な一歩です。

ハサビス氏が強調するように、シミュレーション環境を用いたロボットの効率的なトレーニングへの応用は、多くの産業にブレークスルーをもたらす可能性を秘めています。Googleの持つ豊富な現実世界のデータとの連携も進めば、AIはさらに賢く、私たちの生活に溶け込んでいくでしょう。ハサビス氏が示したビジョンは、AI開発の未来を明るく照らすものと言えます。