近年、オンラインショッピングは私たちの生活に不可欠なものとなりました。実店舗と同じように、商品を手に取り、様々な角度から確認したいというニーズは依然として高く、そのギャップを埋めるべく、テクノロジーは進化を続けています。本稿では、Googleが発表した、少数の商品画像から高品質な3D商品画像を生成する新しいAI技術について解説します。

引用元記事

- タイトル: Bringing 3D shoppable products online with generative AI

- 発行元: Google Labs

- 発行日: 2025年5月12日

- URL: Bringing 3D shoppable products online with generative AI

・本稿中の画像に関しては特に明示がない場合、引用元記事より引用しております。

・記載されている情報は、投稿日までに確認された内容となります。正確な情報に関しては、各種公式HPを参照するようお願い致します。

・内容に関してはあくまで執筆者の認識であり、誤っている場合があります。引用元記事を確認するようお願い致します。

要点

- Googleは、わずか3枚の商品画像から高品質でインタラクティブな3D商品画像を生成する新しい生成AI技術を開発した。これは、Googleの最先端ビデオ生成モデル「Veo」を活用したものである。

- この技術は、オンラインショッピングにおいて、実店舗のような没入感のある商品体験を提供することを目的としている。

- 従来の手法では、3Dモデル作成にコストと時間がかかっていたが、本技術により、より多くの事業者が手軽に3Dコンテンツを導入できるようになる。

- 本技術は、第1世代のNeRF(Neural Radiance Fields)、第2世代のビュー条件付き拡散モデルを経て、第3世代としてVeoを基盤とすることで、より多様な商品カテゴリに対応し、複雑な光の相互作用や素材感を表現できるようになった。

- 入力画像が少ない場合でも高品質な3D画像を生成できるが、3枚程度の複数方向からの画像があれば、より忠実でハルシネーション(AIによる誤った情報の生成)の少ない3D表現が可能である。

詳細解説

オンラインショッピングの課題の一つは、商品を実際に手に取って確認できないことでした。 この課題を解決するため、Googleは長年にわたり3D商品表示技術の開発に取り組んできました。

技術の進化:3つの世代

本稿で紹介する技術は、一朝一夕に生まれたものではありません。Googleは、よりリアルで実用的な3D商品表示を目指し、段階的に技術を進化させてきました。

第1世代:Neural Radiance Fields (NeRFs)

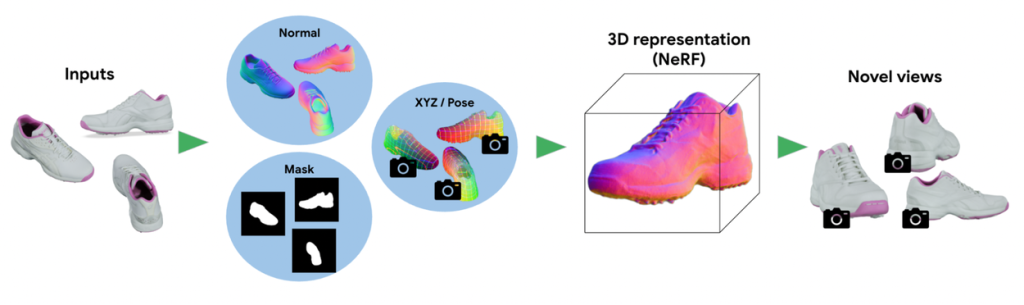

2022年に発表されたこの技術は、NeRFというニューラルネットワークを用いて、5枚以上の商品画像から360度のスピン表示のような新しい視点の画像を生成するものでした。 具体的には、最適な画像の選択、不要な背景の除去、3Dプライヤーの予測、カメラ位置の推定、そして3D表現の最適化といった多くのサブ問題を解決する必要がありました。 この技術は有望でしたが、入力信号のノイズや入力ビューの少なさによる曖昧さが課題となり、特にサンダルやヒールのような細い構造や複雑な形状の商品の再構築は困難でした。

※NeRFとは?

NeRFとは、複数の2次元画像から、その物体やシーンの3次元的な情報をAIが学習し、任意の位置や角度からの見た目を新たに作り出す技術です。ある方向から撮影された写真数枚をAIに見せることで、そのAIが物体全体の形を理解し、まだ見ていない角度からの写真も生成できるようなイメージです。これにより、例えば商品の360度ビューなどを実現できます。

第2世代:ビュー条件付き拡散モデルによるスケーリング

2023年に導入された第2世代のアプローチでは、第1世代の限界に対処するためにビュー条件付き拡散モデルが採用されました。 「ビュー条件付き」とは、例えば靴の上面の画像を与えて「この靴の正面はどのように見えるか?」とモデルに問いかけることができることを意味します。これにより、限られた視点の写真しかない場合でも、あらゆる視点から靴がどのように見えるかを予測するのに役立ちます。このアプローチにより、Googleショッピングで日常的に閲覧される多くの靴の3D表現を生成できるようになり、スケーラビリティが大幅に向上しました。

※拡散モデルとは?

拡散モデルは、元々ノイズだらけの画像から、徐々にノイズを取り除いていくことで、最終的に鮮明な画像を生成するAI技術の一種です。近年、高品質な画像生成AIの多くにこの技術が使われています。

第3世代:Veoによる汎用化

最新のブレークスルーは、Googleの最先端ビデオ生成モデルであるVeoを基盤としています。Veoの主な強みは、光、素材、質感、形状の間の複雑な相互作用を捉えたビデオを生成する能力です。

Veoを製品画像から一貫性のある360度ビデオに変換するためにファインチューニングするにあたり、まず高品質な3D合成アセットのデータセットが作成されました。次に、これらの3Dアセットを様々なカメラアングルと照明条件でレンダリングし、最終的にペア画像のデータセットを作成し、1枚以上の画像に基づいて360度スピンを生成するようにVeoを教師あり学習させました。このアプローチは、家具、アパレル、電子機器など、多様な製品カテゴリに効果的に汎用化できることが判明しました。

Veoは、利用可能な製品画像に忠実な新しいビューを生成できるだけでなく、第1世代および第2世代のアプローチでは困難だった複雑な照明と素材の相互作用(光沢のある表面など)も捉えることができました。さらに、この第3世代のアプローチは、対象物中心の製品画像から正確なカメラポーズを推定する必要性を回避し、問題を簡素化し信頼性を向上させました。1枚の画像からでもリアルな3D表現を生成できますが、入力画像が増えるほど、Veoは忠実度の高い高品質な新しいビューを生成する能力が向上します。実際には、物体のほとんどの表面を捉えた3枚程度の画像があれば、3D画像の品質を向上させ、ハルシネーションを減らすのに十分であることがわかりました。

※Google Veoとは?

Veoは、Google DeepMindによって開発された最先端のAIビデオ生成モデルです。テキストや画像による指示(プロンプト)に基づいて、高品質でリアルな動画を生成することができます。例えば、「夕暮れの平原を馬に乗って横切るカウボーイ」といったテキストから、その情景を描いた動画を作り出すことができます。また、既存の動画に編集指示を加えて新しい動画を生成することも可能です。現在、Veo2が Gemini Advancedから利用できます。

まとめ

Googleが開発した、少数の画像から高品質な3D商品画像を生成するAI技術は、オンラインショッピング体験を大きく変革する可能性を秘めています。

NeRFから始まり、ビュー条件付き拡散モデル、そして最新のVeoへと進化したこの技術は、よりリアルでインタラクティブな商品表示を可能にし、消費者と事業者の双方にメリットをもたらすと考えられます。

日本においても、Eコマース市場の活性化や新たなビジネスチャンスの創出が期待される一方で、技術導入に伴う課題にも目を向け、適切に対応していくことが重要です。今後の技術の進化と、それが私たちのオンラインショッピング体験をどのように豊かにしていくのか、引き続き注目していきます。