はじめに

Googleが2025年11月20日、GeminiアプリにインタラクティブなAI生成画像機能を追加したことを発表しました。この機能により、消化器系や細胞の構造といった複雑な学術概念を、図の各部分をタップやクリックすることで視覚的に探索できるようになります。本稿では、この新機能の仕組みと学習体験への影響について解説します。

参考記事

- タイトル: Develop a deeper understanding with interactive images in Gemini

- 著者: Dave Messer (Product Manager, Learning & Education)

- 発行元: Google Blog

- 発行日: 2025年11月20日

- URL: https://blog.google/outreach-initiatives/education/gemini-interactive-images/

要点

- Geminiアプリにインタラクティブ画像機能が追加され、学習における能動的な関与を促進する設計となっている

- 消化器系や細胞の部位などの図において、特定の部分をタップまたはクリックすることでインタラクティブパネルが開く

- パネルには即座に定義、詳細な説明、さらに深掘りできるコンテンツが表示される

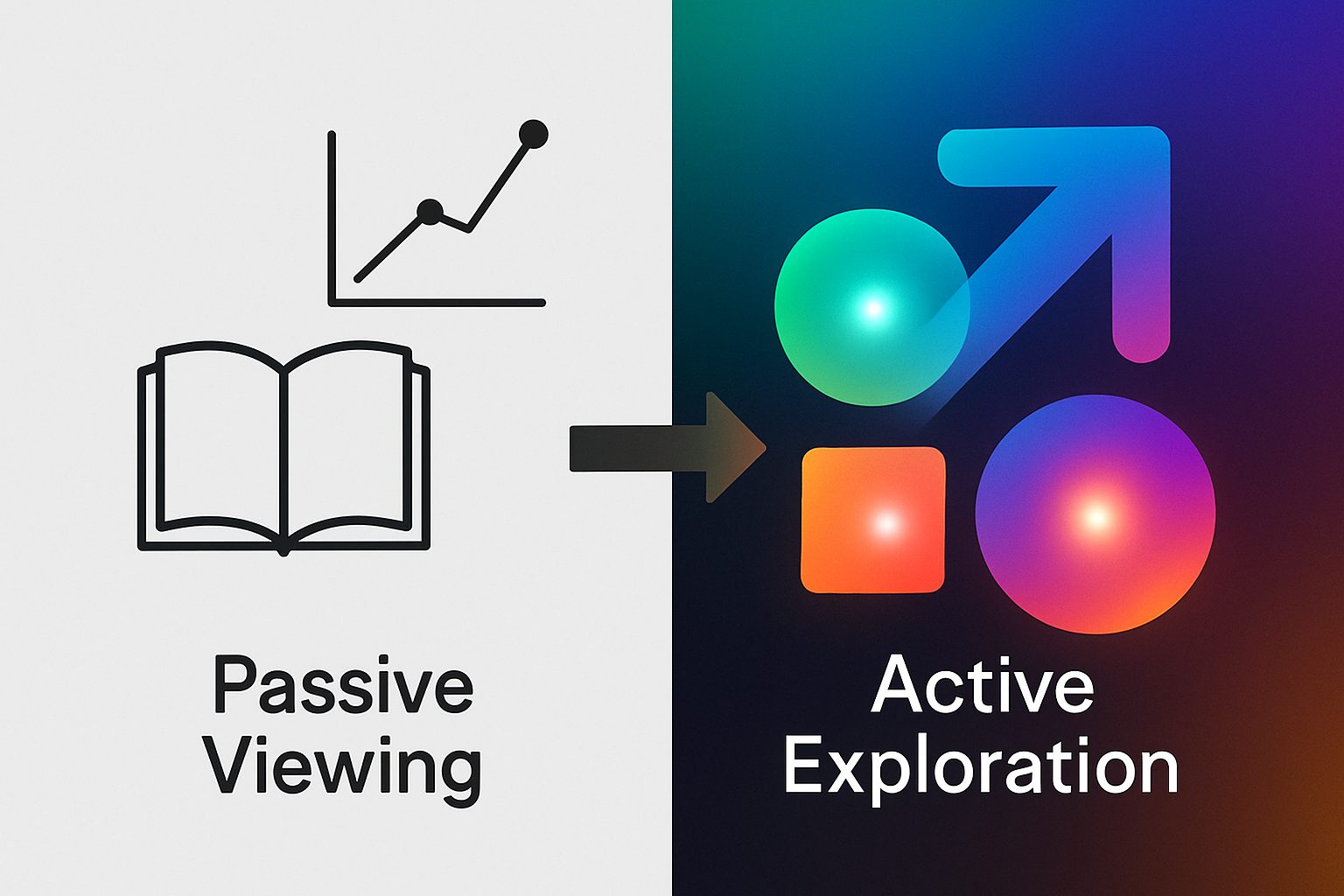

- 受動的な閲覧から能動的な探索へと学習スタイルを転換し、学習をより視覚的、動的、アクセシブルにすることを目指している

詳細解説

学習科学に基づく設計思想

Googleによれば、この機能は「真の学習には能動的な関与が必要」という学習科学の原則に基づいて設計されています。従来の静的なテキストや画像による学習では、情報を受動的に受け取るだけになりがちでしたが、インタラクティブ画像では学習者が能動的に図の各部分を探索できます。

学習科学の分野では、能動的学習(Active Learning)が記憶の定着や理解の深化に効果的であることが多くの研究で示されています。特に視覚的な教材において、学習者が自ら情報を探索し、必要な箇所を選択して詳細を確認できる環境は、受動的な閲覧よりも学習効果が高いと考えられています。

インタラクティブパネルの仕組み

具体的な使用例として、Googleは消化器系や細胞の部位の学習を挙げています。ユーザーが図の特定の部分をタップまたはクリックすると、その部分に関するインタラクティブパネルが開きます。このパネルには、即座に定義が表示されるほか、詳細な説明やさらに深掘りできるコンテンツが含まれています。

この機能は、特定の画像に対して利用可能となっており、トピックに関するより多くの情報を得たり、フォローアップの質問をしたりすることができます。従来の検索やテキストベースの質問と異なり、視覚的な図から直接情報にアクセスできる点が特徴です。

学習体験の変化

Googleは、この機能によって「受動的な閲覧から能動的な探索へ」と学習スタイルが転換されると説明しています。単にラベルを見るだけでなく、学習者が自ら興味のある部分を選択し、必要な深さまで情報を掘り下げられる点が重要です。

教育テクノロジーの観点では、このような双方向性のある学習ツールは、学習者の好奇心を刺激し、自己主導的な学習を促進する効果があると考えられます。特に、複雑な生物学的構造や化学的プロセスなど、視覚的な理解が重要な分野において有効でしょう。

アクセシビリティへの配慮

Googleは、この機能が「学習をより視覚的、動的、アクセシブルにする重要なステップ」であると位置づけています。インタラクティブパネルによって、必要な情報に直接アクセスできることは、学習障壁を下げる効果があると期待されます。

ただし、現時点では「特定の画像」に対してのみ機能が利用可能とされており、どのような画像が対応しているのか、また今後の対応範囲の拡大については追加情報が待たれるところです。

まとめ

Geminiのインタラクティブ画像機能は、学習科学の原則に基づき、受動的な閲覧から能動的な探索へと学習体験を転換する試みです。図の各部分をタップして詳細情報にアクセスできる仕組みは、特に視覚的理解が重要な学術分野での活用が期待されます。今後、対応する画像の範囲がどのように拡大していくのか注目されます。