はじめに

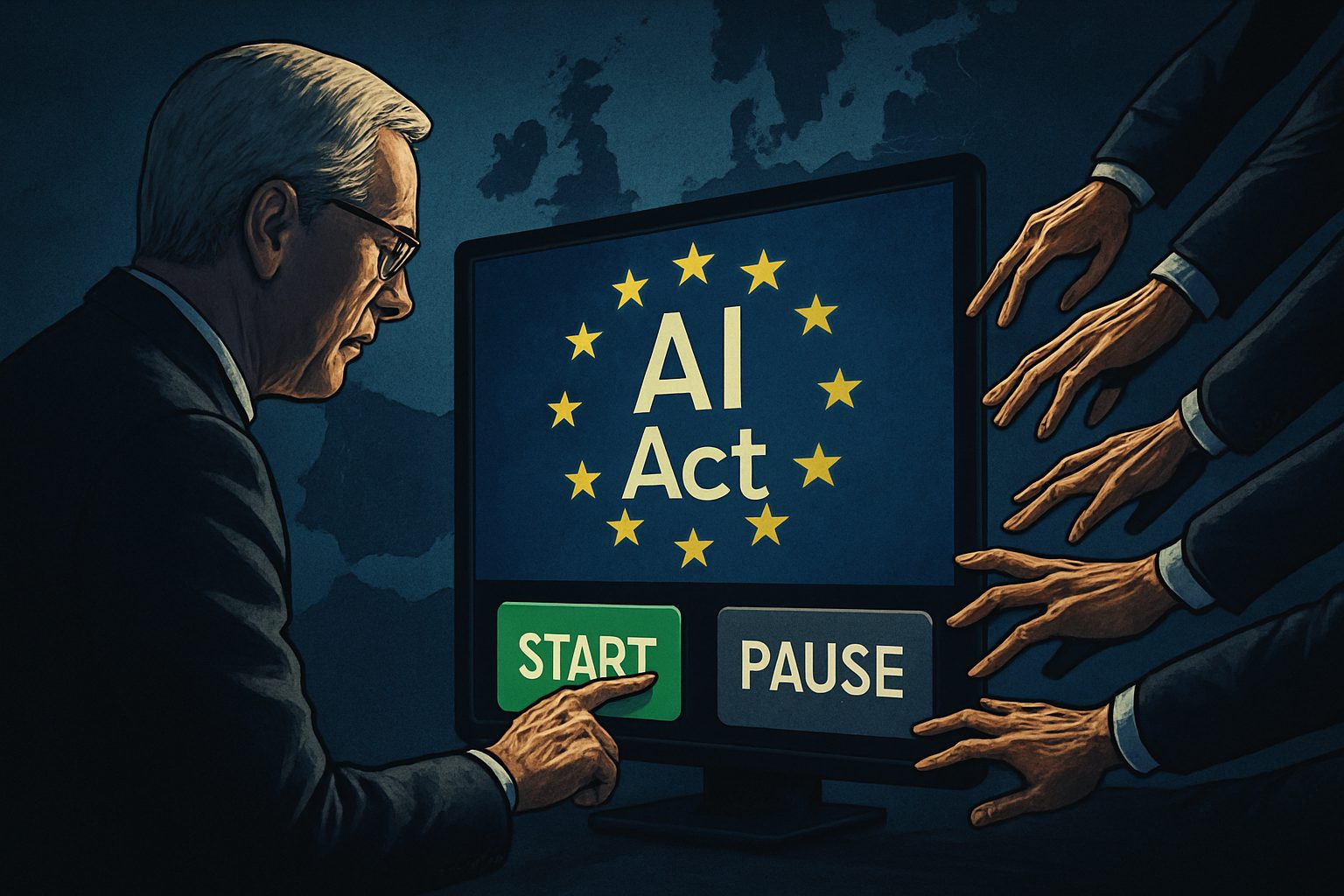

人工知能(AI)技術の急速な発展は、私たちの社会に計り知れない可能性をもたらす一方で、新たなリスクや課題も生み出しています。このような状況の中、欧州連合(EU)は世界初の包括的なAI規制である「AI法」の施行を着実に進めており、その動向が国際的な注目を集めています。

こうした動向に関して、AI関連の主要企業46社のCEOがAI法の2年間停止を求める異例の公開書簡を発表した一方で、欧州委員会は大手テック企業からの延期要請を断固として退け、予定通りの施行を宣言しています。本稿では、AI時代における「イノベーション」と「規制」の根本的なジレンマとEUの対応について、解説します。

引用元記事

- タイトル: EU sticks with timeline for AI rules

- 発行元: Reuters

- 発行日: 2025年7月4日

- URL: https://www.reuters.com/world/europe/artificial-intelligence-rules-go-ahead-no-pause-eu-commission-says-2025-07-04/

- タイトル: Europe’s top CEOs ask EU to pause AI Act

- 発行元: POLITICO

- 発行日: 2025年7月4日

- URL: https://www.politico.eu/article/top-european-ceos-plead-for-pause-in-ai-act/

要点

- 産業界の強い反発: ヨーロッパの基幹産業を代表する46社のCEOが、AI法の2年間停止を求める異例の公開書簡を発表

- EUの断固たる意志: 欧州委員会は企業側の要請を退け、「時計を止めることも、猶予期間も、一時停止もない」と宣言

- 規制の複雑性への懸念: 企業側は規制の不明確さと実装の困難さがイノベーションを阻害すると主張

- 段階的施行の継続: 2025年8月に汎用AIモデル、2026年8月に高リスクAIシステムの規制が順次開始予定

詳細解説

産業界からの異例の反旗 – 46社CEOの訴え

今回の動きで最も注目すべきは、その参加企業の多様性と影響力の大きさです。フランスの新進AIスタートアップMistral AIから、航空宇宙の巨人Airbus、半導体製造装置で世界トップシェアを誇るオランダのASML、ドイツの航空会社Lufthansaまで、業界の垣根を越えた46社が結束したのです。

これは単なるテック企業の反発ではありません。製造業、航空業、エネルギー、金融など、現代社会の基盤を支える幅広い産業がAI規制の直接的な影響を受けるという現実を如実に示しています。AIがもはや特定の業界の専門技術ではなく、あらゆる産業の競争力を左右する「社会インフラ」と化していることの証左といえるでしょう。

CEOたちが訴える核心的な問題は、規制の「不明確さ」と「複雑さ」です。彼らは「何が許されて何が違反なのかが分からない状況で、巨額の投資とコンプライアンス対応を迫られている」と主張しています。この状況は、企業にとって受け入れがたいビジネスリスクを生み出すだけでなく、ヨーロッパ企業が米中の競合他社に対して構造的な不利を背負うことを意味しているのです。

EUの揺るぎない決意 – 「ブリュッセル効果」の再現を狙う

一方、欧州委員会の断固たる姿勢の背景には、複数の戦略的意図が読み取れます。

第一に、市民の基本的人権保護という価値観の貫徹です。EUにとってAI法は、差別、プライバシー侵害、不公平な自動判断といったAIの負の側面から人々を守る「盾」としての役割を担っています。企業の利益よりも市民の権利を優先するというEUの理念が、ここに明確に表れています。

第二に、AI規制における世界的主導権の確立という野心があります。EUは過去に個人情報保護規則(GDPR)で示したように、その巨大な単一市場の力を活用して域内ルールを事実上の世界標準にする「ブリュッセル効果」の再現を狙っています。AI分野でも自らの価値観に基づいたルールをグローバルスタンダードにすることで、技術発展の方向性そのものを主導しようとしているのです。

AI法の全体像 – リスクベース・アプローチの詳細

議論の中心となっているAI法は、AIシステムを社会に与えるリスクの度合いによって4段階に分類し、それぞれに異なる義務を課す「リスクベース・アプローチ」を採用しています。

- 許容できないリスク(禁止): サブリミナル操作技術、公的機関による包括的な社会スコアリング、職場や教育機関での感情認識AIなど、人間の尊厳を脅かすAIは原則として使用禁止

- 高リスク(厳格な規制): 医療機器、重要インフラの制御、採用・人事評価、信用評価、司法・法執行で使用されるAI。これらには高品質データの使用、リスク管理システムの構築、人間による監視、透明性の確保、正確性と頑健性の証明など、極めて厳格な要件が課される

- 限定的リスク(透明性義務): チャットボットや感情認識システム。利用者がAIとやり取りしていることを明確に認識できるようにする透明性義務

- 最小リスク(自主規制): スパムフィルターやゲームAIなど。特別な法的義務はなく、業界の自主的な行動規範に委ねられる

加えて、ChatGPTのような「汎用AIモデル」には特別な規定が適用され、一定の計算能力を超えるモデルには安全性評価、システムリスクの軽減、サイバーセキュリティの確保などが義務付けられます。

対立の深層 – イノベーションと規制の本質的ジレンマ

今回の対立は、AIという革命的技術に人類がどう向き合うべきかという根本的な問いを投げかけています。

企業側の懸念は決して軽視できません。厳格な規制要件を満たすためには、システムの根本的な再設計、新たな監査・認証プロセス、専門人材の大幅な増員が必要となり、それは巨額の追加コストを意味します。特に、近年のAI技術の中核であるディープラーニングは「ブラックボックス」化が進んでおり、AI法が求める「説明可能性」や「透明性」を技術的に実現することは極めて困難な挑戦です。

さらに深刻なのは、グローバル競争への影響です。アメリカでは比較的緩やかな自主規制が主流であり、中国は国家主導で急速なAI開発を推進しています。このような環境下で、ヨーロッパ企業だけが厳格な規制の制約を受けることは、国際競争力の著しい低下を招く可能性があります。

一方、EUの立場にも十分な理屈があります。AIの急速な普及は既に社会に深刻な問題を引き起こしており、採用プロセスでの差別、司法判断の偏見、監視技術の濫用などが実際に報告されています。これらの問題に対する予防的な規制なしには、AIの恩恵よりもリスクの方が社会全体にとって大きくなる可能性があるのです。

段階的施行のスケジュールと実務への影響

AI法の施行は段階的に進められ、企業や開発者は以下のタイムラインに沿って対応を迫られます。

- 2025年8月: 汎用AIモデルの規制開始。ChatGPT、Claude、Geminiなどの開発者は、モデルの技術文書作成、安全性テスト結果の報告、システムリスクの評価・軽減策の実施が義務化

- 2026年8月: 高リスクAIシステムの本格規制開始。医療、交通、金融、人事などの分野でAIを活用する企業は、厳格な要件をすべて満たす必要がある

この段階的なアプローチにより、企業には一定の準備期間が与えられますが、同時に継続的な対応コストと技術的挑戦が課せられることになります。

世界への波及効果と日本への示唆

EUのAI法は、その影響が欧州域内にとどまらないことが予想されます。多国籍企業にとって、EUという巨大市場での事業継続は不可欠であり、結果的に世界中のAI開発がEU基準に合わせて行われる可能性が高いからです。

日本政府は現在、AI戦略の策定を進めていますが、EUの経験は貴重な先例となるでしょう。規制とイノベーションのバランスをどう取るか、技術的実現可能性をいかに担保するか、国際競争力をいかに維持するかといった課題は、日本も近い将来直面することになります。

また、日本企業にとっては、EU市場での事業展開を考える上で、AI法への対応が避けて通れない課題となります。早期からの準備と戦略的な対応が、競争優位性を左右する要因となる可能性があります。

今後の展望と課題

現在の対立状況を踏まえると、今後いくつかのシナリオが考えられます。

最も可能性が高いのは、実装の過程での段階的な調整です。EUは基本的な枠組みは維持しつつも、企業側の実務的な困難に配慮して、具体的な要件や実装方法について柔軟性を持たせる可能性があります。実際、欧州委員会は「施行基準やガイドラインの準備が遅れれば、一時停止も検討する」と述べており、完全に妥協を拒んでいるわけではありません。

一方で、技術革新による解決の可能性もあります。説明可能AI(XAI)、プライバシー保護技術、自動監査システムなどの発展により、規制要件を満たしながらも効率的なAI開発が可能になるかもしれません。

しかし、根本的な価値観の対立が解消されない限り、この種の緊張関係は続くでしょう。技術の発展速度と規制の整備速度のギャップ、経済効率と社会的価値の優先順位、グローバル競争と地域的価値観の両立といった課題は、AI時代の永続的なテーマとなる可能性があります。

まとめ

ヨーロッパの主要企業とEUの間で繰り広げられているAI法を巡る攻防は、単なる地域的な規制問題を超えた、人類のAIとの向き合い方を決定づける歴史的な分水嶺といえるでしょう。

企業側が懸念するイノベーションの阻害とコンプライアンス負担、そしてEUが目指す市民の権利保護と倫理的AI発展。この二つの正当な要求の間で適切なバランスを見つけることは、技術の進歩と社会の調和を両立させる上で不可欠です。

世界初となるこの壮大な実験の行方は、AI技術の未来だけでなく、デジタル社会における人間の尊厳と自由をいかに守るかという根本的な問いへの回答を左右します。その結果は、日本を含む世界中の国々のAI政策に大きな影響を与えることになるでしょう。