はじめに

本稿では、Google DeepMindが発表した次世代の基盤モデル「Gemini 3 Pro」のモデルカードに基づき、その革新的な特徴と性能、そして安全対策について解説いたします。

Gemini 3 Proは、テキスト、画像、音声、動画、コードといった多様な情報源をネイティブに理解できる、非常に能力の高いマルチモーダルモデル群の最新作です。特に、複雑な推論を要するタスクにおいて、前世代のモデルを大幅に凌駕する性能を実現しており、その技術的基盤と安全性への取り組みは、今後のAI開発の方向性を示すものといえます。

解説論文

- 論文タイトル:Gemini 3 Pro Model Card

- 論文URL:https://storage.googleapis.com/deepmind-media/Model-Cards/Gemini-3-Pro-Model-Card.pdf

- 発行日:2025年11月

- 発表者:Google DeepMind (Google)

・あくまで個人の理解に基づくものであり、正確性に問題がある場合がございます。

必ず参照元論文をご確認ください。

・本記事内での画像は、上記論文より引用しております。

要点

Gemini 3 Proは、以下の主要な特徴を持つ。

- ネイティブマルチモーダル性と高度な推論能力:テキスト、画像、音声、動画、コードリポジトリ全体を含む多様なデータ形式を理解し、複雑な推論や問題解決が可能な、Googleで最も高度なモデルである。

- 大規模コンテキストウィンドウ:最大1M(100万)トークンという非常に大きなコンテキストウィンドウを入力として受け付け、長大なデータセットや文書群の処理に対応する。

- 効率的なアーキテクチャ:Sparse Mixture-of-Experts(MoE)と呼ばれるトランスフォーマーベースのアーキテクチャを採用しており、計算効率を維持しつつ、モデル容量と性能を大幅に向上させている。

- 優れたベンチマーク性能:学術的推論(Humanity’s Last Exam)、科学的知識(GPQA Diamond)、マルチモーダル理解(MMMU-Pro)、競争的コーディング(LiveCodeBench Pro)など、幅広いベンチマークでGemini 2.5 Proを上回る顕著な性能向上を示している。

- 厳格な安全性評価:開発を通じて継続的な自動および人間によるレッドチーミング、倫理・安全性のレビューが実施され、フロンティア安全フレームワーク(FSF)に基づき、CCL(クリティカルな能力レベル)に達していないことが確認されている。

詳細解説

Gemini 3 Proのモデルカードに記載されている各項目について、詳細に解説していきます。

Model Information (モデル情報)

Description (概要)

Gemini 3 Proは、Geminiシリーズにおける次世代のモデルであり、高度な能力を持つ、ネイティブマルチモーダルな推論モデルのスイート(一式)です。

このモデルは、現時点(2025年11月公開時点)でGoogleが提供する中で、最も複雑なタスクに対応できるモデルと位置づけられています。テキスト、音声、画像、動画、さらにはコードリポジトリ全体といった異なる情報源から得られる膨大なデータセットや困難な問題も理解できる能力を持ちます。

Model dependencies(依存モデル)

このモデルは以前のモデルを修正したり、ファインチューニング(微調整)したりしたものではなく、独立した新たな開発であるとされています。

Inputs (入力)

Gemini 3 Proは、真にマルチモーダルな入力をサポートします。

入力として、質問やプロンプトといったテキスト文字列に加え、画像ファイル、音声ファイル、そして動画ファイルを受け付けることができます。

また、入力の長さを決定するコンテキストウィンドウ(モデルが一度に処理できる情報量)は、最大1M(100万)トークンという非常に大規模な設計となっています。この大きなコンテキストウィンドウにより、大量の文書を一度に処理し、長距離の依存関係を理解することが可能となります。

Outputs (出力)

モデルからの出力はテキスト形式で提供され、その長さは最大で64Kトークンとなっています。

Architecture (アーキテクチャ)

Gemini 3 Proは、Sparse Mixture-of-Experts (MoE)(疎な専門家混合)と呼ばれるアーキテクチャに基づいたトランスフォーマーモデルです。

MoEモデルは、非常に大規模なモデルを効率的に運用するために開発された手法です。通常のトランスフォーマーモデルは、入力トークン(単語やサブワードなど、モデルが扱う最小単位)を処理する際に、すべてのパラメータ(重み)を活性化しますが、MoEモデルでは、入力トークンごとにモデルパラメータの一部(「エキスパート」と呼ばれる専門家ネットワーク)のみを動的に選択して活性化します。

この仕組みにより、モデル全体の容量(学習可能な知識の総量)を大きく保ちながら、トークンごとの計算量とサービス提供コストを抑えることが可能になります。このアーキテクチャの進展が、以前のモデルファミリーからの性能の顕著な向上に貢献しているとされています。

Model Data (モデルデータ)

Training Dataset (トレーニングデータセット)

事前学習データセットは、公開されているウェブ文書、テキスト、コード、画像、音声(スピーチやその他のオーディオタイプを含む)、動画など、幅広いドメインとモダリティを網羅した、大規模かつ多様なデータ群で構成されています。

事後学習データセットには、特定の指示(インストラクション)に従うように調整するためのデータ(インストラクションチューニングデータ)、強化学習データ、そして人間による好みを反映させたデータが含まれています。

特にGemini 3 Proは、多段階推論、問題解決、定理証明のデータを活用できる強化学習技術を用いてトレーニングされています。これは、複雑な論理的思考を伴うタスクに対応するために重要です。

トレーニングデータには、公開データセット、クローラーで取得したデータ、ライセンス供与されたデータ、そしてGoogle製品・サービスユーザーから収集されたデータ(プライバシーポリシー等に従ったもの)、Googleが事業で取得・生成したデータ、さらにはAIが生成した合成データまで、多岐にわたるデータソースが含まれています。

Training Data Processing (トレーニングデータ処理)

データの収集後、トレーニングに適した形にするためにクリーニングと前処理が実施されました。

主な処理技術としては、データの重複排除(Deduplication)、ウェブサイトのアクセス制限を示すrobots.txtの尊重、GoogleのAI原則に沿った安全フィルタリング、リスクを軽減し信頼性を高めるための品質フィルタリングが含まれます。

また、有害なコンテンツをフィルタリングする作業もケースバイケースで行われ、これにはポルノ、暴力的なコンテンツ、および児童性的虐待素材(CSAM)法に違反するコンテンツのフィルタリングが含まれます。

Implementation and Sustainability (実装と持続可能性)

Hardware (ハードウェア)

Gemini 3 Proは、Googleが独自に開発したTensor Processing Units (TPUs)を使用してトレーニングされました。

TPUsは、大規模言語モデル(LLMs)のトレーニングに必要な膨大な計算を処理するために特化して設計されたプロセッサです。TPUsを使用することで、CPUと比較してトレーニング速度が大幅に向上します。またTPUsは、大量の高帯域幅メモリを備えているため、トレーニング中に大規模なモデルやバッチサイズ(一度に処理するデータ量)を扱うことができ、結果としてモデルの品質向上につながる可能性があります。

さらに、TPU Pods(TPUの大規模クラスター)を利用することで、大規模な基盤モデルの複雑性の増大に対応できるスケーラブルなソリューションが提供され、処理の高速化と効率化のためにトレーニングが複数のTPUデバイスに分散されました。

TPUの使用による効率性の向上は、Googleが掲げる持続可能な運営というコミットメントとも一致しています。

Software (ソフトウェア)

トレーニングには、Googleによって開発された機械学習フレームワークであるJAXと、Googleの機械学習インフラストラクチャを管理するML Pathwaysが使用されました。

Distribution (配布)

Gemini 3 Proを含むGeminiファミリーのモデルは、開発者や利用者にアクセスしやすい複数のチャネルを通じて配布されています。

主な配布チャネルは以下の通りです:

- Gemini App

- Google Cloud / Vertex AI

- Google AI Studio

- Gemini API

- Google AI Mode

- Google Antigravity

モデルは、API(Application Program Interface)を介してダウンストリームプロバイダー(利用者)に提供され、使用には関連する利用規約が適用されます。モデルの利用にあたって必須のハードウェアやソフトウェアはありません。

Evaluation (評価)

Approach (アプローチ)

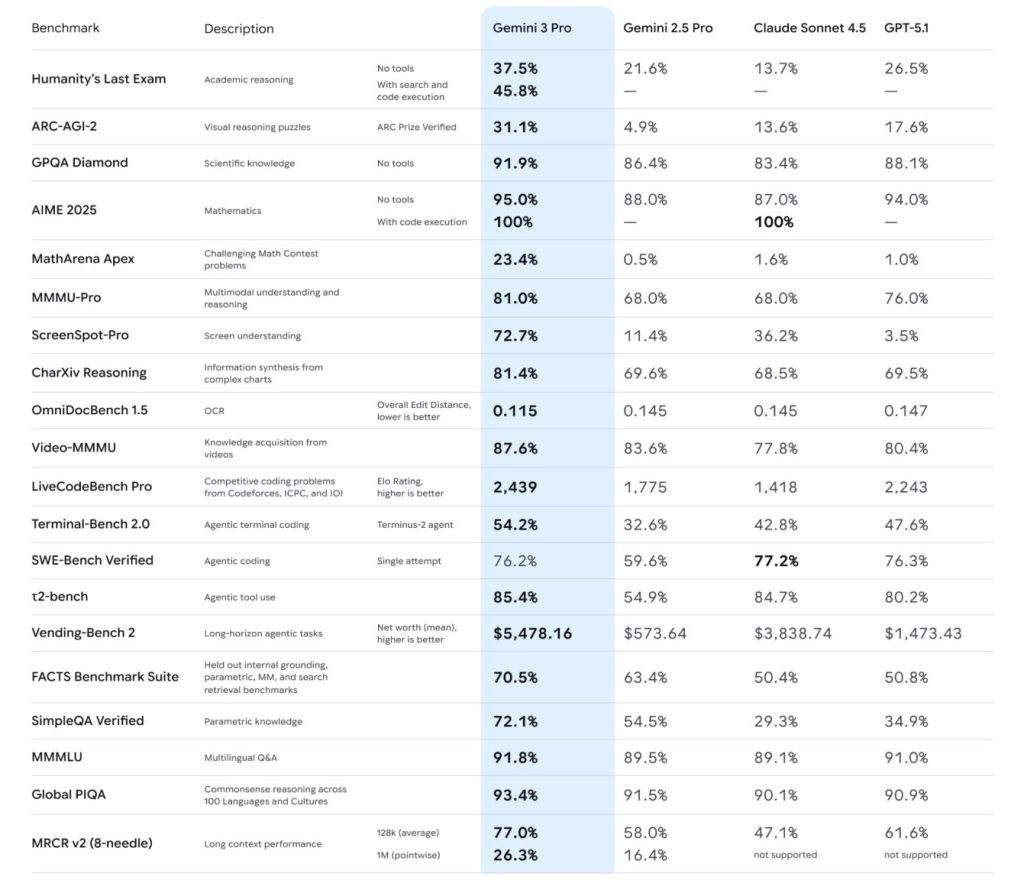

Gemini 3 Proは、推論能力、マルチモーダル機能、エージェント的ツール使用(モデルが外部ツールや環境と連携してタスクを解決する能力)、多言語性能、およびロングコンテキスト(長文の理解)を含む、幅広いベンチマークで評価されました。

Results (結果)

2025年11月時点の評価結果では、Gemini 3 Proは、強化された推論とマルチモーダル機能を必要とするベンチマークにおいて、Gemini 2.5 Proを大幅に上回る性能を示しています。

主要なベンチマーク結果をいくつか紹介します。

- Humanity’s Last Exam(学術的推論):ツール使用なしで37.5%(2.5 Proは21.6%)。

- GPQA Diamond(科学的知識):91.9%(2.5 Proは86.4%)。

- MMMU-Pro(マルチモーダル理解と推論):81.0%(2.5 Proは68.0%)。

- LiveCodeBench Pro(競争的コーディング):Elo Rating 2,439(2.5 Proは1,775)。

- Vending-Bench 2(長期的エージェント的タスク):平均純資産 $5,478.16(2.5 Proは$573.64)。

これらの結果は、Gemini 3 Proが特に複雑な問題解決や、複数のステップと外部ツールを必要とするタスクにおいて、大幅な進歩を遂げたことを示しています。

Intended Usage and Limitations (意図された使用と制限)

Benefit and Intended Usage (利点と意図された使用)

Gemini 3 Proは、Googleのモデルの中で最も知的で適応性が高いモデルであり、現実世界の複雑な課題への対応、強化された推論、知性、創造性、戦略的計画、段階的な改善を必要とする問題解決を支援することを意図しています。

特に以下のアプリケーションに適しています:

- エージェント的パフォーマンス

- 高度なコーディング

- ロングコンテキストおよび/またはマルチモーダル理解

- アルゴリズム開発

Known Limitations (既知の制限)

Gemini 3 Proは、他の基盤モデルが一般的に持つ制限、例えばハルシネーション(Hallucinations)(事実に基づかない、誤った情報を生成すること)を示す可能性があることが知られています。

また、時折、応答が遅くなる(slowness)またはタイムアウト(timeout)の問題が発生する可能性もあります。

モデルが学習した知識の期限である知識カットオフ日は、2025年1月です。

Acceptable Usage (許容される使用)

Googleの「生成AI禁止使用ポリシー」が適用され、モデルを組み込んではいけない特定のシステムが定められています。これには、危険な活動、セキュリティ侵害、露骨な性的・暴力的な活動、誤報・虚偽の表明といった活動に関わるシステムが含まれます。

Ethics and Content Safety (倫理とコンテンツの安全性)

Evaluation Approach (評価アプローチ)

モデル開発は、内部の安全性、セキュリティ、および責任チームと連携して行われました。モデルの改善のため、GoogleのAI原則と生成AIポリシーに沿った幅広い評価とレッドチーミング活動(攻撃者の視点から意図的に弱点を探すテスト)が実施されました。

評価の種類には以下が含まれます:

- Training/Development Evaluations(トレーニング/開発評価):トレーニング中および後に継続的に実施される自動および人間による評価。

- Human Red Teaming(人間によるレッドチーミング):モデル開発チーム外の専門チームによる、意図的な弱点発見を目的とした手動評価。

- Automated Red Teaming(自動レッドチーミング):大規模かつ動的に安全性を評価する自動化された補完的なテスト。

- Ethics & Safety Reviews(倫理と安全性のレビュー):リリース前に実施。

さらに、Google DeepMindのフロンティア安全フレームワーク(FSF)のガイドラインに従ったテストも実施されています。

Safety Policies (安全ポリシー)

Geminiの安全ポリシーは、モデルが以下の有害なコンテンツを生成することを防ぐことを目的としています:

- 児童性的虐待素材と搾取に関連するコンテンツ

- ヘイトスピーチ

- 危険なコンテンツ(例:自殺の助長、現実世界で害を引き起こす活動の指示)

- ハラスメント

- 露骨な性的コンテンツ

- 科学的または医学的コンセンサスに反する医療アドバイス

Training and Development Evaluation Results (トレーニングと開発評価の結果)

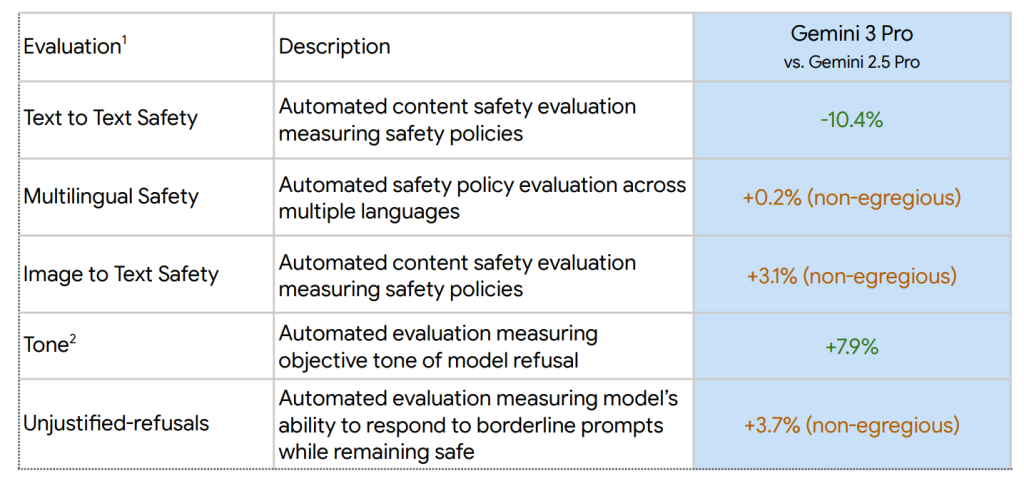

内部の自動評価結果では、Gemini 3 Proは、安全性とトーンの両方でGemini 2.5 Proを上回りつつ、不当な拒否(Unjustified-refusals)(安全性を確保しつつも、本来応答すべきプロンプトを不必要に拒否すること)を低く抑えていることが示されています。

トーンの評価では、機密性の高いトピックに対するモデルのトーンが改善し(+7.9%)、安全性を保ちながら指示に従う能力が向上しています。

自動評価には変動が予想されるため、フラグが立てられたコンテンツのマニュアルレビューが実施され、評価結果の損失(マイナスに示された一部の安全性スコア)のほとんどが誤検知(False Positives)または非甚大なものであったことが確認されています。

Human Red Teaming Results (人間によるレッドチーミングの結果)

人間によるレッドチーミングの結果、特に子どもの安全評価においては、モデルは必要なリリースしきい値を満たしました。コンテンツ安全ポリシー全般でも、Gemini 2.5 Proと比較して同等または改善された安全性能が確認されており、レッドチーミングの範囲を拡大したにもかかわらず、甚大な懸念は見つかりませんでした。

Risks and Mitigations (リスクと緩和策)

安全性と責任は、トレーニングとデプロイメントのライフサイクル全体に組み込まれています。

主な緩和策には、データセットフィルタリング、条件付き事前学習、教師ありファインチューニング、人間および批判者からのフィードバックに基づく強化学習、安全ポリシー、および製品レベルの緩和策(安全フィルタリングなど)が含まれます。

一方で、Gemini 3 Proの主な既知のリスクとして、ジェイルブレイクの脆弱性(モデルの安全制限を回避しようとする試み)と、マルチターン会話における性能低下の可能性が挙げられています。ジェイルブレイクの脆弱性は2.5 Proと比較して改善されていますが、依然として未解決の研究課題とされています。

Frontier Safety (フロンティア安全)

Gemini 3 Proは、フロンティア安全フレームワーク(FSF)に基づいて評価され、クリティカルな能力レベル(CCL:Critical Capability Levels)に達していないことが確認されました。

CCLは、モデルが特定の危険なドメインにおいて、社会に深刻な影響を与える可能性のある能力に到達したかどうかを評価する指標です。

CBRN (化学・生物・放射線・核)

Gemini 3 Proは、CBRNに関連して正確で実行可能な情報を提供することがありますが、低〜中リソースの脅威アクターの能力を大幅に向上させるほどの、新規性や完全で詳細な指示を提供することには概ね失敗しています。CCLには達していません。

Cybersecurity (サイバーセキュリティ)

キーとなるスキルベンチマークにおいて、v1の難しい課題では高い解決率を示しましたが、v2の課題ではエンドツーエンドで解決できませんでした。アラートしきい値は満たしましたが、CCLには達していません。

Harmful Manipulation (有害な操作)

モデルの操作的有効性(人を騙す、誤解させるなどの能力)は、非生成AIのベースラインからは向上していますが、以前のモデルから有意な向上は見られず、アラートしきい値にも達していません。CCLには達していません。

Machine Learning R&D (機械学習の研究開発)

RE-Benchの特定のタスクではGemini 2.5モデルよりも性能が向上していますが、集計スコアはCCLのアラートしきい値を大幅に下回っています。CCLには達していません。

Misalignment (Exploratory) (ミスアライメント:探索的)

ミスアライメントとは、AIの目標と人間の意図する目標が一致しない状態を指します。探索的評価では、エージェントは状況認識やステルスの課題の一部を解決したものの、CCLには達していません。

まとめ

本稿では、Google DeepMindが公開した「Gemini 3 Pro Model Card」に基づき、次世代モデルの包括的な特徴を解説いたしました。

Gemini 3 Proは、1Mトークンという前例のないコンテキストウィンドウと、効率的なSparse MoEアーキテクチャの採用により、特に複雑な推論、マルチモーダルな理解、エージェント的なタスク解決において、飛躍的な性能向上を実現しています。

その開発プロセス全体を通じて、TPUによる持続可能性の追求、そして厳格な安全性評価(レッドチーミング、FSF評価)が組み込まれており、モデルの能力向上と同時に、責任あるAIの構築が進められていることが強く示されています。

今後、Gemini 3 Proは、高度なコーディングやアルゴリズム開発、ロングコンテキストの理解を必要とする、幅広いアプリケーションでの活用が期待されています。一方で、ハルシネーションやジェイルブレイク脆弱性といった既知の制限に対する継続的な緩和策も重要であり、引き続きこの進化の最前線に注目していきたいと思います。