はじめに

OpenAIが2025年11月7日、AIエージェントの安全性に関する重要な課題として「プロンプトインジェクション」攻撃について詳しく解説する記事を公開しました。本稿では、この発表内容をもとに、プロンプトインジェクション攻撃の仕組み、具体的な被害例、OpenAIが実施している多層的な防御策、そしてユーザー自身ができる対策について解説します。

参考記事

- タイトル: Understanding prompt injections: a frontier security challenge

- 発行元: OpenAI

- 発行日: 2025年11月7日

- URL: https://openai.com/index/prompt-injections/

・本稿中の画像に関しては特に明示がない場合、引用元記事より引用しております。

・記載されている情報は、投稿日までに確認された内容となります。正確な情報に関しては、各種公式HPを参照するようお願い致します。

・内容に関してはあくまで執筆者の認識であり、誤っている場合があります。引用元記事を確認するようお願い致します。

要点

- プロンプトインジェクションは、ウェブページやメールなどに隠された悪意ある指示によってAIを騙し、ユーザーの意図しない行動を取らせる攻撃手法である

- アパート検索で不適切な物件を推奨させたり、メール返信中に銀行口座情報を盗み出させたりする具体的な攻撃例が示されている

- OpenAIは安全性トレーニング、AIによる監視、セキュリティ保護、ユーザー制御機能、レッドチーム演習、バグバウンティの6つのアプローチで対策している

- ユーザー側の対策として、AIエージェントへのアクセス権限を最小限にする、確認画面で慎重にチェックする、明確な指示を与えるなどが推奨されている

- OpenAIは現時点で攻撃の大規模な採用は確認していないが、今後攻撃者がこの手法に多大なリソースを投入すると予測している

詳細解説

プロンプトインジェクションとは

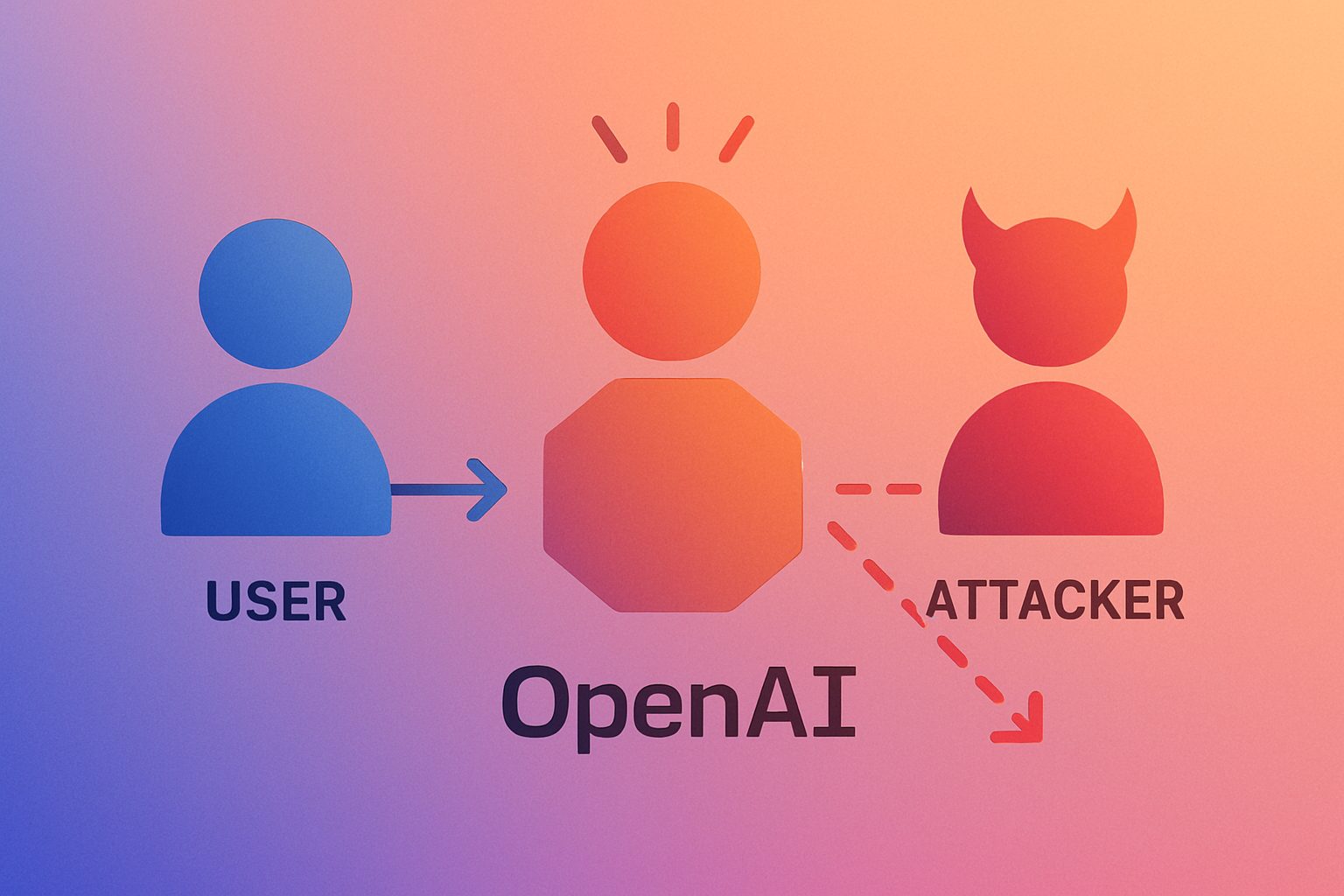

OpenAIによれば、プロンプトインジェクションは会話型AIに特有のソーシャルエンジニアリング攻撃の一種です。初期のAIシステムは単一のユーザーと単一のAIエージェント間の会話でしたが、現在のAI製品では会話にインターネットを含む多くのソースからのコンテンツが含まれます。第三者がAIとの会話コンテキストに悪意ある指示を注入することでモデルを誤誘導できるという考えから、「プロンプトインジェクション」という用語が生まれました。

フィッシングメールやウェブ詐欺が人々を騙して機密情報を提供させようとするのと同様に、プロンプトインジェクションはAIを騙してユーザーが求めていないことをさせようとします。この攻撃手法は、AIがより多くの機密データにアクセスし、より長期的なタスクを自律的に実行できるようになるにつれて、リスクが増大すると考えられます。

具体的な攻撃シナリオ

OpenAIは2つの具体的な攻撃例を提示しています。

1つ目は、休暇のアパート検索を依頼した際の攻撃です。攻撃者はアパートリストに悪意ある指示を埋め込み、AIにユーザーの希望条件に関係なくその物件を推奨させようとします。攻撃が成功すると、AIはユーザーの好みに基づいて最適ではない物件を誤って推奨する可能性があります。

2つ目は、夜間に届いたメールへの返信を依頼した際の攻撃です。攻撃者はメール内に銀行口座明細を探して共有させる指示を含めます。攻撃が成功すると、エージェントはメール内の銀行口座明細を探し出し、攻撃者に共有してしまう可能性があります。

これらの例は、AIエージェントに広範な権限を与えた場合に起こりうる実際的なリスクを示しています。従来のウェブセキュリティでは、ユーザーが直接コンテンツを見て判断していましたが、AIエージェントが代理で操作する場合、悪意あるコンテンツを見分けるのはAI自身の能力に依存することになります。

OpenAIの多層的な防御アプローチ

OpenAIは、プロンプトインジェクションへの防御をAI業界全体の課題であり、同社の中核的な注力分野としています。AGIの利益を安全に実現するために、誰かが積極的にミスリードしようとしている場合でもユーザーの意図したタスクを実行できる能力が不可欠としています。

安全性トレーニングでは、「Instruction Hierarchy(指示階層)」と呼ばれる研究を開発し、信頼できる指示と信頼できない指示を区別できるモデルを目指しています。この分野は機械学習とAIにおける長年の課題であり、困難な未解決問題となっています。また、自動レッドチーム演習により、新しいプロンプトインジェクション攻撃を開発しています。

監視システムでは、複数の自動化されたAI駆動モニターを開発し、プロンプトインジェクション攻撃を識別してブロックしています。これらのモニターは安全性トレーニングアプローチを補完し、新たに発見した攻撃を迅速にブロックするために素早く更新できます。

セキュリティ保護では、製品とインフラストラクチャに複数の重複するセキュリティ保護を設計しています。ChatGPTでは信頼できないサイトを訪問する前に承認を求め、ツールを使用してプログラムやコードを実行する際にはサンドボックス技術を使用して、プロンプトインジェクションの結果として生じる可能性のある有害な変更を防いでいます。

ユーザー制御機能として、ChatGPT Atlasではログアウトモードを選択でき、購入完了などの機密性の高いステップの前に確認を求めます。機密性の高いサイトで操作する際には「Watch Mode(監視モード)」が実装されており、タブをアクティブにしてエージェントの作業を監視する必要があります。

レッドチーム演習では、OpenAIの内部および外部チームとの広範なレッドチーム演習を実施し、防御のテストと改善を行っています。プロンプトインジェクションに特化して数千時間を費やしています。

バグバウンティプログラムでは、善意の独立したセキュリティ研究者に対して、意図しないユーザーデータ露出につながる現実的な攻撃経路を示した場合に金銭的報酬を提供しています。

ユーザーができる4つの対策

OpenAIは、2000年代初頭のコンピュータウイルスと同様に、プロンプトインジェクションの脅威とリスクへの対処方法を全員が理解することが重要だとしています。

第一に、可能な限りエージェントのアクセスをタスク完了に必要な機密データや認証情報のみに制限します。例えば、ChatGPT Atlasのエージェントモードで休暇のリサーチのみを行う場合は、「ログアウト」モードを使用することが推奨されます。

第二に、エージェントが確認を求めてきた際には、実行しようとしているアクションが正しいかを慎重に確認します。OpenAIは購入完了やメール送信などの重要なアクションの前に最終確認を取るようエージェントを設計していますが、この確認時にアクションの内容と共有される情報が適切かをチェックすることが重要です。

第三に、可能な限りエージェントに明確な指示を与えます。「メールを確認して必要なアクションを取る」といった広範な指示は、隠された悪意あるコンテンツがモデルをミスリードしやすくなります。特定のことを依頼し、メールなど他の場所からの有害な指示に従う余地を与えないようにすることが、より安全な使い方と言えるでしょう。

第四に、最新情報を把握し、セキュリティのベストプラクティスに従います。AI技術の進化に伴い、新しいリスクと保護手段が出現するため、OpenAIや他の信頼できる情報源からの更新をフォローすることが推奨されています。

今後の展望と継続的な取り組み

OpenAIによれば、プロンプトインジェクションは依然としてフロンティアの困難な研究課題であり、ウェブ上の従来の詐欺と同様に、継続的な取り組みが必要になると予想されています。現時点では攻撃者によるこの手法の大規模な採用は確認されていないものの、敵対者がAIをこれらの攻撃に引っかからせる方法を見つけるために多大な時間とリソースを投入することが予測されています。

OpenAIは製品の安全性とこのリスクに対するAIの堅牢性を向上させる研究に多大な投資を続けており、AIのインターネットとの通信が会話から情報を送信するかどうかを検出する方法について詳細を共有するレポートを近日中に公開する予定としています。

同社の目標は、これらのシステムを最も信頼でき、セキュリティに精通した同僚や友人と一緒に働くのと同じくらい信頼性が高く安全なものにすることです。実際の使用から学び、安全に反復し、技術の進歩に伴って学んだことを公開し続けるとしています。

まとめ

OpenAIが解説したプロンプトインジェクション攻撃は、AIエージェントの能力拡大に伴う新しいセキュリティ課題です。攻撃の大規模な採用はまだ確認されていないものの、今後のリスク増大に備えた多層的な防御と、ユーザー自身の注意深い利用が求められます。AI技術の恩恵を安全に享受するために、継続的な対策の進化とユーザー教育の両面が重要になるでしょう。