はじめに

本稿では、英国のThe Guardianが2025年6月15日に報じた「Revealed: Thousands of UK university students caught cheating using AI」という記事を基に、英国の大学で急増している生成AIを用いた学業不正の実態を解説します。

引用元記事

- タイトル: Revealed: Thousands of UK university students caught cheating using AI

- 発行元: The Guardian

- 発行日: 2025年6月15日

- URL: https://www.theguardian.com/education/2025/jun/15/thousands-of-uk-university-students-caught-cheating-using-ai-artificial-intelligence-survey

要点

- 英国の大学において、ChatGPTなどのAIツールを使用した学業不正が急増しており、2023-24年度には約7,000件の不正行為が確認された。これは1,000人の学生あたり5.1件に相当する。

- 一方で、従来のコピー&ペーストによる盗用(剽窃)の件数は著しく減少しており、不正の手口が変化していることを示している。

- 専門家は、発覚したAI不正の件数は「氷山の一角」であると指摘している。AIによって生成された文章は、従来の盗用検知システムでは見抜くことが極めて困難であるため、多くの不正が見過ごされている可能性がある。

- レディング大学の研究では、AIが生成した課題が94%の確率で検知システムを通過しており、AI検知技術の限界が示されている。

- 学生はAIを不正目的だけでなく、アイデア出しや文章構成、参考文献の提案といった学習支援ツールとしても活用している。特に学習障害を持つ学生にとって、AIは有効なサポートツールとなり得る側面もある。

- 教育現場は、評価方法の根本的な見直しという大きな課題に直面している。単純な知識の暗記ではなく、AIには代替できないコミュニケーション能力や批判的思考力といったスキルの育成が、今後の教育においてより重要になる。

詳細解説

英国の大学を揺るがすAI不正の驚くべき実態

The Guardian紙の調査により、英国の大学でAIを利用した不正行為がかつてない規模で広がっていることが明らかになりました。2022-23年度には1,000人あたり1.6件だったAI不正の摘発件数は、2023-24年度には5.1件へと3倍以上に急増しました。さらに初期のデータに基づくと、今年度は7.5件に達する見込みです。これは、学生たちの間でAIツールを使ったレポート作成や課題遂行が、驚くべき速さで常態化しつつあることを示唆しています。

しかし、専門家が口を揃えて指摘するのは、これらの数字でさえ「氷山の一角」に過ぎないという厳しい現実です。なぜなら、AIによる不正は、これまでの不正とは根本的に性質が異なるからです。

なぜAIによる不正は見抜くのが難しいのか?

従来の不正行為の主流は「盗用(剽窃)」でした。これは、他人の論文やウェブサイトの文章をそのまま、あるいは少しだけ手直しして自分のものとして提出する行為です。大学側は、提出されたレポートを専用のソフトウェアにかけ、既存の膨大なデータベースと照合することで、盗用箇所を高い精度で発見することができました。

ところが、ChatGPTのような生成AIは、文章をコピーするのではなく、学習したデータに基づいて「オリジナルの文章をその場で生成」します。そのため、既存の文章と完全に一致することはなく、従来の盗用検知システムではほとんど検出できません。

もちろん、AIが書いた文章か人間が書いた文章かを判定しようとする「AI検知ツール」も存在します。しかし、記事で紹介されているレディング大学の研究が示すように、その精度はまだ十分ではありません。さらに、学生側もAIが生成した文章を検知ツールから隠すための「人間化(Humanizing)」ツールを利用するケースがあります。これは、AIが書いた不自然な部分を修正し、より人間らしい表現に書き換えるもので、不正の発見を一層困難にしています。

大学側も、無実の学生を「AI不正を行った」と誤って告発するわけにはいかず、確たる証拠がない限り追及が難しいというジレンマを抱えています。

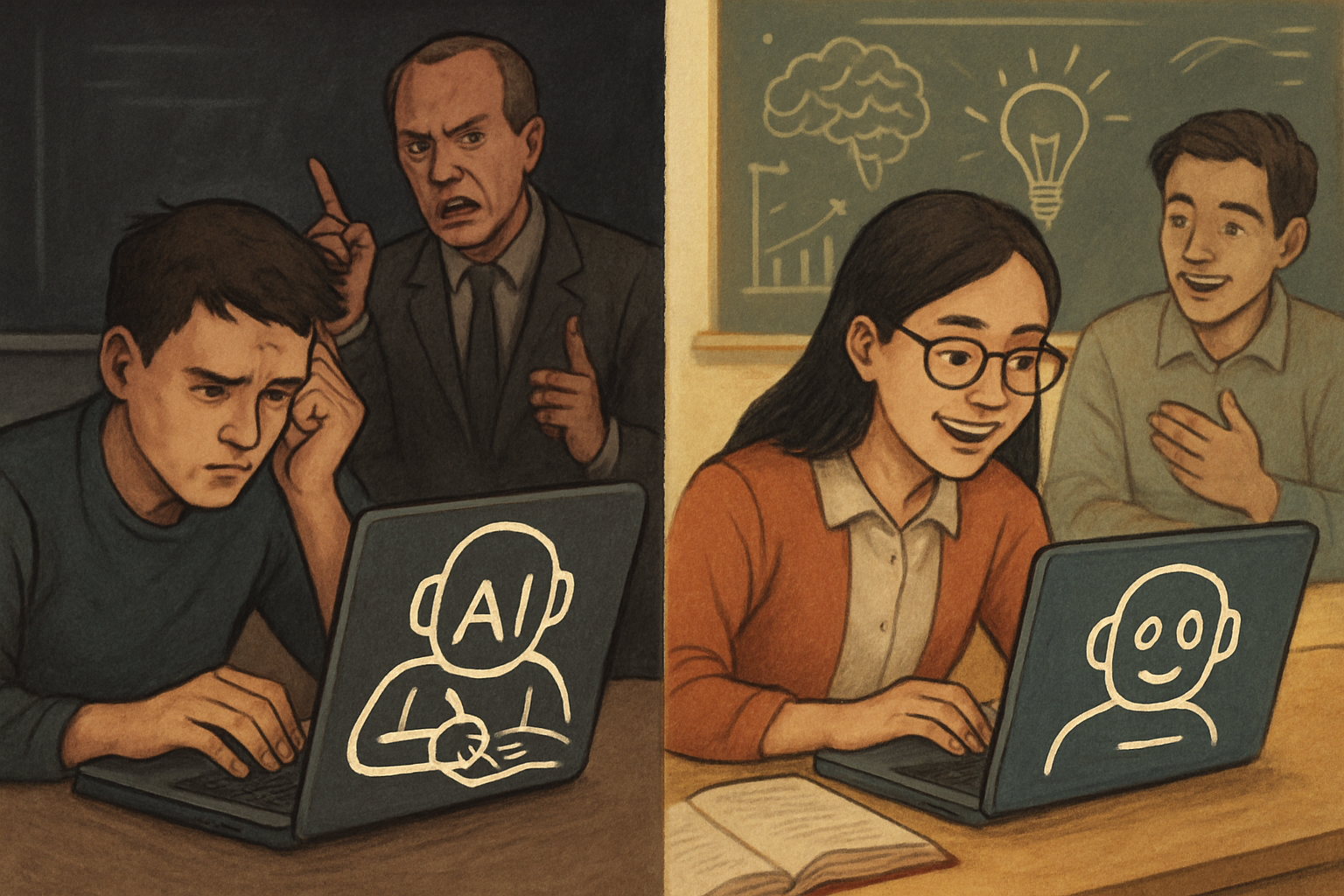

学生はAIをどう使っているのか?光と影

本稿が興味深いのは、学生のAI利用を一方的に「悪」と断じていない点です。記事に登場する学生は、AIを単に答えを丸写しするための道具としてではなく、アイデアを出すためのブレインストーミングや、レポート全体の構成を考えるための壁打ち相手として活用していると語ります。

これは、AIが思考の補助輪として機能している実態を示しています。特に、失読症(Dyslexia)といった学習障害を持つ学生にとって、自分の考えを構造化し、適切な文章にする上でAIが大きな助けとなっているという証言は、非常に重要です。テクノロジーが、これまで学習に困難を抱えていた学生のハンディキャップを補う「レベリングアップ」のツールとなり得る可能性を示しています。

しかし、その一方で、安易にAIに頼り、思考のプロセスを放棄してしまう危険性も常に存在します。どこまでが許容される「支援」で、どこからが許されない「不正」なのか。その線引きは非常に曖昧であり、教育現場全体で議論していく必要があります。

問われる教育の未来:評価方法の変革と新たなスキル

この問題の根底にあるのは、「私たちは何を評価しようとしているのか」という根源的な問いです。もし評価の目的が、知識を正確に記憶し、再生することであるならば、その価値はAIの登場によって大きく揺らいでいます。

インペリアル・カレッジ・ロンドンの研究者であるトーマス・ランカスター博士は、「丸暗記や知識の保持の価値は年々減少し続けている」と指摘します。そして、これからの教育は、AIには容易に代替できないスキル、すなわちコミュニケーション能力、対人スキル、そして新しい技術と向き合い、それを使いこなす自信を育むことに焦点を当てるべきだと主張しています。

AIを不正の道具として恐れ、禁止するだけでは、この大きな変化の波に対応することはできません。むしろ、AIをいかにして学習に積極的に取り入れ、学生の能力を最大限に引き出すかという視点への転換が求められています。それは、レポートや試験といった従来の評価方法を根本から見直すことを意味します。

まとめ

The Guardian紙の報道は、英国の大学が直面するAI不正という深刻な問題を浮き彫りにしました。しかし、これは決して対岸の火事ではありません。日本においても、学生によるAIの利用はすでに始まっており、同様の課題がすぐそこまで迫っています。

本稿で見てきたように、この問題は単なる「不正行為の増加」という側面だけでは捉えきれません。AI検知技術の限界、学習支援ツールとしてのAIの可能性、そして評価のあり方そのものへの問い直しといった、多角的で根深い論点を含んでいます。 重要なのは、AIを敵視し排除するのではなく、その特性を正しく理解し、共存していく道を探ることです。学生には、AIを思考停止の道具ではなく、自らの知性を拡張するためのツールとして使いこなす倫理観とリテラシーが求められます。そして教育機関には、知識の量だけでなく、学生が持つ独自の視点や創造性、協調性といった、より人間的な能力を正当に評価するための新しい仕組みを設計する責任があります。